Chaque chef d'entreprise se demande : comment pouvons-nous tirer parti de l'IA pour obtenir un avantage concurrentiel ? Les responsables de la sécurité posent une question différente : comment adopter l'IA sans créer des milliers de risques de sécurité nouveaux, autonomes et invisibles ?

De notre point de vue, en aidant à sécuriser plus de 20 000 organisations mondiales, nous voyons ce défi se dérouler en temps réel. L'essor de l'IA générative et agentique entraîne une explosion des identités non humaines (INH). Ces agents d'IA peuvent fonctionner à la vitesse d'une machine, accéder à des données sensibles, appeler des API critiques et prendre des décisions au nom des utilisateurs.

Cela crée une crise d’identité fondamentale. Les systèmes IAM traditionnels, conçus pour un accès prévisible piloté par l’humain, ne sont pas équipés pour cette réalité. Sans une approche moderne, les entreprises sont confrontées à un angle mort : Quels agents ont accès à quoi ? Leurs autorisations sont-elles appropriées ? Comment arrêter un agent compromis avant qu’il ne cause des dommages ?

La sécurisation de l’avenir de l’IA commence par l’identité. Cet article explore comment les normes et cadres d’IA émergents, tels que MCP, A2A et RAG, permettent de nouvelles fonctionnalités et introduisent également d’importants défis de sécurité, et explique pourquoi leur résolution nécessite une approche axée sur l’identité.

Qui adopte l'IA ? Et pourquoi adoptent-ils l'IA ?

Dans tous les secteurs, les organisations adoptent l'IA de trois manières principales :

L'IA au service du personnel : de nombreuses entreprises déploient des technologies d'IA pour donner plus de pouvoir à leurs employés. Le succès dépend de l'acquisition d'un fournisseur de confiance et de la gestion du réseau croissant d'accès que les plateformes d'IA gagnent au sein de l'entreprise.

L'IA pour les partenariats B2B: Certaines organisations intègrent l'IA dans les services destinés aux partenaires ou aux fournisseurs. Leur priorité est un délai de rentabilité rapide, associé à une exposition sécurisée des capacités d'IA à des tiers.

Constructeurs de produits natifs de l'IA : Ces entreprises développent les produits alimentés par l'IA que d'autres évaluent. Ils se concentrent sur l'innovation et s'appuient sur des cadres de sécurité solides pour aider à garantir la confiance dans les environnements de production.

Dans les trois groupes, le besoin est constant : une sécurité qui évolue avec l'adoption de l'IA.

Évolution des normes dans l'écosystème de l'IA

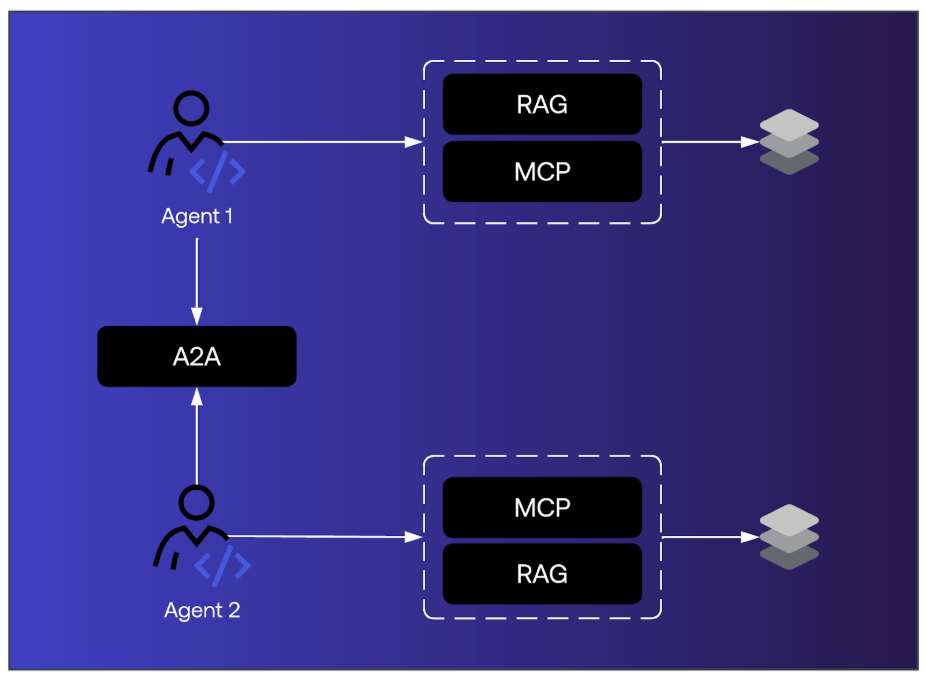

L'écosystème de l'IA évolue rapidement vers la normalisation. De nombreux protocoles sont proposés, mais trois se distinguent par leur impact à court terme sur l'entreprise : Model Context Protocol (MCP), agent-to-agent communication (A2A) et retrieval-augmented generation (RAG).

MCP : un protocole axé sur le contexte

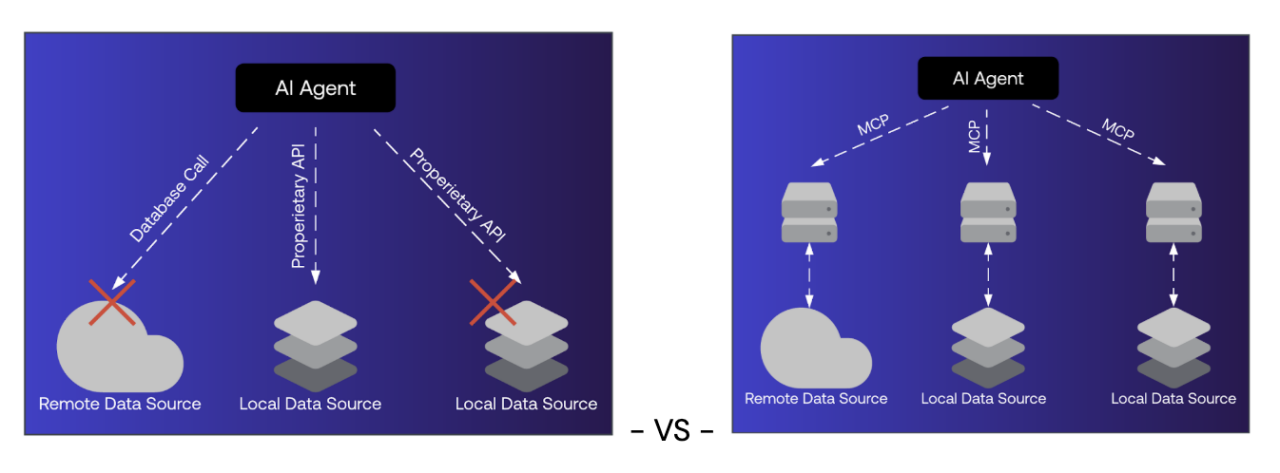

MCP, développé par Anthropic, agit comme un traducteur universel entre les modèles d’IA et les systèmes externes. Au lieu d’exiger que chaque agent s’adapte aux particularités de chaque API, MCP fournit un protocole cohérent pour accéder aux outils et aux ressources.

Par exemple, un PDG pourrait demander à un assistant d'IA d'analyser les données de vente d'un système de CRM, d'un système d'inventaire et d'une plateforme de comptabilité. Avec MCP, l'assistant n'a pas besoin d'intégrations personnalisées ; il peut interagir avec chaque système via une norme commune. MCP transforme l'agent d'IA en une boîte à outils universelle.

Les implications en matière de sécurité sont importantes. MCP facilite l'accès et le rend plus cohérent, mais il augmente également les enjeux de l'authentification et de l'autorisation. OAuth 2.1 fait partie de la spécification, mais il n'aborde pas entièrement la nature dynamique et axée sur les tâches de l'intégration des agents et les risques d'usurpation d'identité.

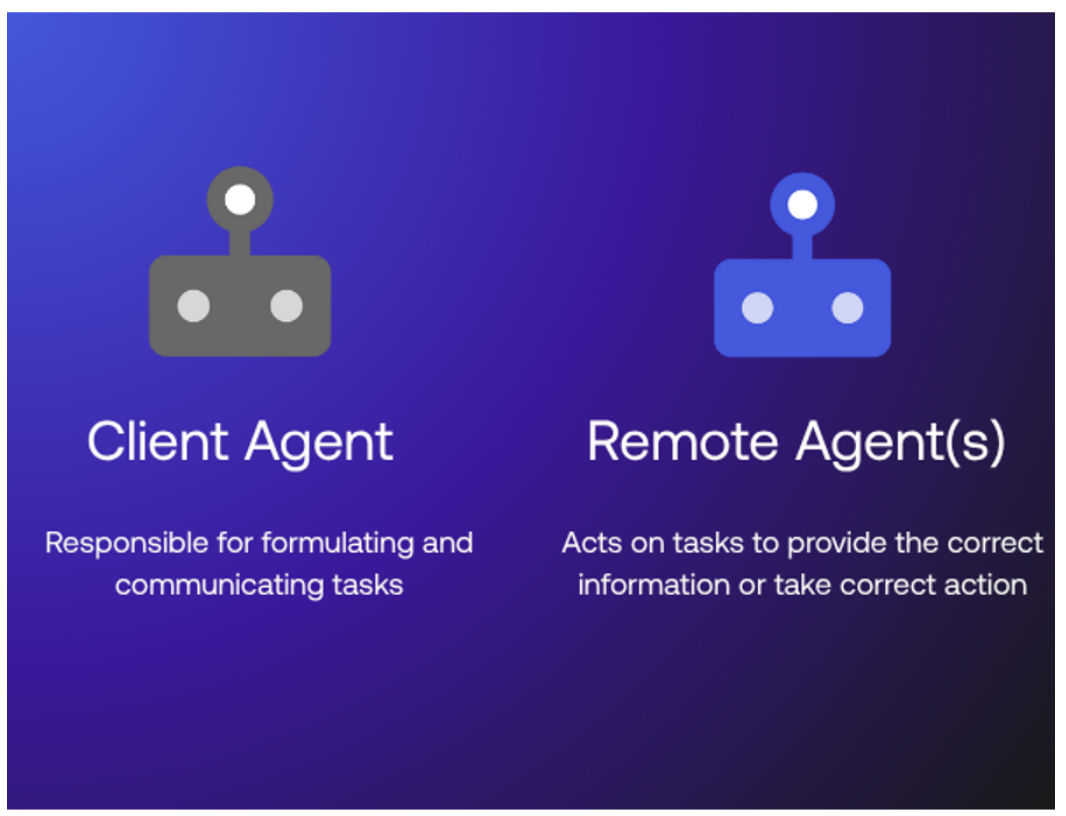

A2A : Un protocole inter-agent

Si MCP équipe les agents individuels, A2A leur permet de travailler ensemble. A2A est un cadre émergent de Google Cloud qui propose des « cartes d'agent » standardisées pour décrire les capacités des agents. Ces cartes permettent aux agents de diviser le travail, de coordonner les tâches et de collaborer à des objectifs complexes. Le potentiel est clair. Imaginez des agents d'IA représentant des fournisseurs, des expéditeurs et des détaillants se coordonnant en temps réel pour résoudre une perturbation de la chaîne d'approvisionnement.

Les défis de sécurité sont également clairs. Sans contrôles d'identité stricts, A2A peut devenir un canal d'usurpation d'identité, d'interception ou de collaboration malveillante. La modélisation des menaces avec le cadre MAESTRO de la Cloud Security Alliance a déjà identifié des scénarios tels que des agents se faisant passer pour des entités de confiance ou des serveurs se faisant passer pour des participants légitimes.

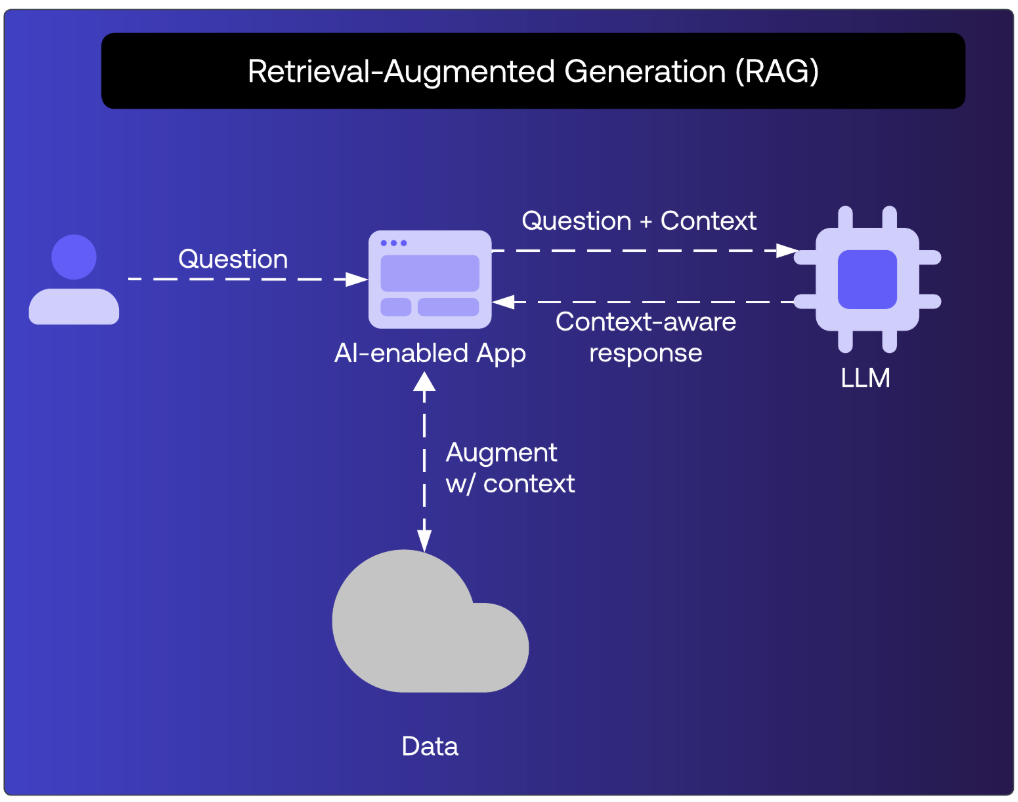

RAG : non pas un protocole, mais un framework

Les modèles d'IA générative sont puissants, mais leurs connaissances sont limitées aux données d'entraînement. La génération augmentée par la récupération (RAG) les améliore en récupérant des informations provenant de sources en direct avant de générer une réponse. Cela permet de s'assurer que les résultats sont exacts, à jour et fondés sur les données de l'entreprise.

Imaginez un directeur financier qui s'enquiert des résultats budgétaires du quatrième trimestre. Un modèle sans RAG peut fournir une réponse obsolète ou fabriquée. Avec RAG, le modèle interroge d'abord les systèmes réels de l'entreprise, puis répond avec des chiffres vérifiés.

La RAG est essentielle pour la confiance de l'entreprise, mais elle crée également des défis en matière d'autorisation. Les pipelines RAG impliquent souvent de vastes ensembles de données, et décider quelle partie de ces ensembles de données un agent doit accéder nécessite des contrôles précis et en temps réel.

Rassembler le tout : les normes en tant que catalyseurs et multiplicateurs de risque

MCP, A2A et RAG élargissent chacun les capacités des agents d’IA. Ensemble, ils forment l’épine dorsale de l’écosystème de l’IA agentique.

Leur adoption, cependant, amplifie également les risques. Les NHIss se multiplient à un rythme que les systèmes IAM actuels ne peuvent pas gérer. Les agents agissent de manière autonome, imprévisible et à grande échelle. Sans l’identité au centre, les entreprises sont confrontées à des risques de sécurité qui pourraient nuire aux avantages de l’IA.

Comment les normes créent de nouvelles considérations de sécurité

Les organisations sont depuis longtemps confrontées aux identités de machines telles que les comptes de service et les clés API. Celles-ci deviennent souvent surprivilégiées ou orphelines, créant ainsi des angles morts en matière de gouvernance.

L'IA agentique amplifie le problème. Au lieu de gérer des centaines de comptes, les entreprises géreront bientôt des milliers d'agents, chacun avec ses propres autorisations dynamiques. Cela représente un changement de nature, pas seulement d'échelle. Les frameworks IAM actuels n'ont pas été conçus pour ce niveau de complexité.

Lacunes introduites par les normes

Le MCP crée de nouveaux défis de gestion des identités et des accès pour les agents. Le MCP améliore l'interopérabilité en offrant aux agents un moyen standardisé d'accéder aux outils et systèmes d'entreprise. Parallèlement, il introduit de nouveaux défis en matière d'identité. Les cadres traditionnels de gestion des identités et des accès (IAM) ont du mal à reconnaître, authentifier et autoriser les agents d'IA dont les schémas d'accès sont dynamiques et axés sur les tâches.

Un agent qui peut utiliser MCP pour interroger plusieurs systèmes doit d'abord être intégré en toute sécurité et vérifié en permanence. Sans ces protections, la même efficacité qui rend MCP puissant augmente également le risque d’accès non autorisé, de comportement malveillant ou d’usurpation d’identité par des agents malveillants.

A2A introduit de nouveaux risques pour la confiance inter-agents et la communication sécurisée. La promesse d'A2A est une collaboration transparente entre des agents autonomes. La réalité est que sans bases d'identité solides, chaque nouvelle connexion devient une vulnérabilité potentielle.

Lorsque les agents échangent des données sensibles et coordonnent des tâches, les attaquants peuvent tenter d'usurper l'identité d'agents de confiance, d'intercepter des messages ou de manipuler des interactions. La modélisation des menaces A2A a déjà mis en évidence des risques tels que des serveurs malveillants se faisant passer pour des entreprises légitimes, le vol d'informations d'identification d'agents et l'escalade non autorisée de la confiance. L'établissement d'une communication sécurisée et d'une identité vérifiable entre divers agents est essentiel pour que l'A2A passe du concept à l'adoption par les entreprises.

La RAG crée de nouveaux schémas d'accès qui augmentent la précision des données et les risques de divulgation d'informations. La RAG réduit les hallucinations en ancrant les sorties dans les données de l'entreprise, mais ce faisant, elle introduit des exigences d'autorisation complexes. Un système d'IA équipé de RAG peut avoir besoin d'interroger des magasins de données massifs.

Le fait de décider quelles parties de ces magasins sont accessibles à quels agents, dans quels contextes, nécessite une autorisation beaucoup plus granulaire que ce que la plupart des entreprises appliquent aujourd'hui. Sans ces contrôles, les agents pourraient exposer des informations sensibles ou générer des résultats qui violent les normes de conformité. À mesure que les entreprises mettent à l'échelle les pipelines RAG, la capacité d'appliquer des décisions d'accès affinées en temps réel devient une exigence de sécurité, et non une fonctionnalité.

Défis plus larges pour les entreprises

À mesure que les agents d'IA entreprennent des actions plus autonomes, les entreprises doivent savoir exactement qui — ou quoi — a initié chaque étape. S'agissait-il d'un humain faisant une demande directe, ou d'un agent agissant au nom de cet utilisateur des heures plus tard ?

Sans attribution claire, les enquêtes criminalistiques sont au point mort et les rapports de conformité deviennent peu fiables. Ce manque de responsabilisation affaiblit également la confiance, car les organisations ont du mal à démontrer leur contrôle sur la prise de décision autonome.

Les systèmes d'IA sont particulièrement vulnérables aux techniques telles que l'empoisonnement des données, l'inversion de modèle et l'injection d'invite. Ces attaques sont conçues pour manipuler le comportement des agents ou extraire des informations sensibles.

Dans un écosystème agentique, où les systèmes communiquent et s'appuient sur les résultats des autres, un seul agent compromis peut propager le risque dans de nombreux domaines. La protection contre les tactiques hostiles nécessite une sécurité des points de terminaison et une surveillance continue du comportement des agents basée sur l'identité.

Les agents d'IA opèrent souvent sur des tâches de longue durée. Ils peuvent demander une approbation une fois, puis continuer à exécuter des actions longtemps après que l'humain est passé à autre chose. Cela crée des risques tels que la fatigue d'approbation, où les utilisateurs cliquent sur des invites répétées sans examen minutieux, ou la perte de contexte, où il devient difficile de savoir exactement ce que l'agent est autorisé à faire. Sans un mécanisme permettant de réintroduire les humains dans la boucle au bon moment, les entreprises risquent de perdre de la responsabilité et de s'exposer à des actions non autorisées.

Le framework OAuth permet depuis longtemps aux utilisateurs de connecter des applications en accordant un accès multiplateforme. Dans un contexte de consommation, cette hypothèse (selon laquelle l'utilisateur final possède et contrôle la connexion) est logique. Dans l'entreprise, ce n'est pas le cas.

Les entreprises doivent autoriser ces connexions par politique, et non par discrétion individuelle. À mesure que l'IA évolue, le nombre de connexions inter-applications et agent-à-application augmentera considérablement, aggravant un problème qui existe déjà aujourd'hui. Sans gouvernance centralisée, les équipes de sécurité ne sont pas conscientes du vaste maillage des autorisations créées par les agents.

Comment Okta sécurise l'IA agentique

L’identité doit être le fondement de la sécurité de l’IA. La plateforme d’Okta régit à la fois les humains et les NHI, comblant ainsi les lacunes introduites par MCP, A2A et RAG.

Le cadre complet de sécurité de l'IA d'Okta

Okta peut découvrir, intégrer, gouverner et surveiller les agents d’IA de la même manière qu’il gère les identités humaines. Les politiques contribuent à assurer la visibilité, la responsabilisation et l’harmonisation avec les normes de l’entreprise.

Sécurité avant, pendant et après l’authentification

- Avant l'authentification : les entreprises obtiennent des informations sur l'accès des agents et appliquent l'intégration basée sur des politiques.

- Pendant l'authentification : Les décisions d'accès sont contextuelles. Un agent peut avoir des droits, mais les politiques déterminent s'il peut agir sur ces droits dans un scénario donné.

- Après l'authentification : La surveillance continue permet une conformité permanente. Okta peut révoquer les jetons, avertir les équipes SOC ou automatiser la correction si des risques sont détectés.

Capacités d'Okta pour la sécurité de l'IA

Accès entre applications (XAA) : une extension d'OAuth conçue pour l'IA agentique, XAA centralise la supervision des connexions entre applications et pilotées par des agents, permettant aux entreprises d'appliquer des politiques sans avoir à recourir à des approbations répétitives des utilisateurs.

Empêcher le partage des autorisations : Grâce à la prise en charge d'OAuth2 Demonstrating Proof-of-Possession (DPoP) et d'OAuth 2.0 Mutual-TLS Client Authentication (mTLS), Okta permet de s'assurer que les tokens ne peuvent pas être volés ou réutilisés. Seul l'agent qui reçoit un jeton peut l'utiliser.

Coffre-fort de jetons Okta (courtier MCP) : les développeurs qui créent des applications d’IA ont souvent besoin de se connecter à de nombreux services externes. Token Vault stocke les jetons d’utilisateur en toute sécurité et agit comme un courtier MCP, simplifiant ainsi l’intégration à grande échelle.

Accès A2A sécurisé. Avec l’échange de jetons, Okta prend en charge les chaînes d’autorisation déléguées qui commencent par une identité humaine et s’étendent à travers plusieurs agents, en maintenant la précision et la capacité d’audit.

Validation asynchrone. En utilisant le flux d’authentification « Client-Initiated Backchannel Authentication Flow » d’OAuth2 (CIBA), Okta permet des approbations humaines sécurisées pour les processus d’agent de longue durée, équilibrant ainsi la responsabilité et l’efficacité.

Autorisation précise pour RAG. La solution FGA d'Okta applique l'autorisation en temps réel au niveau de la requête, ce qui permet de garantir que les agents d'IA accèdent uniquement aux données que les utilisateurs sont autorisés à consulter.

Pourquoi Okta est un leader en matière de sécurité de l'IA

Okta offre déjà des solutions pour les défis liés à l’identité de l’IA.

- Avantage du pionnier : La gestion des identités des agents d'IA est disponible dès maintenant, pas sur une feuille de route.

- Échelle d'entreprise : approuvée par plus de 20 000 clients gérant des milliards de connexions mensuelles.

- Leadership en matière de normes : Participation active aux normes de sécurité de l'IA émergentes telles que MCP et A2A.

- Plateforme complète : Identité, gouvernance et autorisation qui répondent aux défis actuels et futurs de la sécurité de l'IA

Grâce à de nouvelles initiatives telles que Auth0 for AI Agents et XAA, Okta étend son framework d’identité pour répondre aux exigences uniques des agents d’IA et de leurs interactions.

Prochaines étapes pour les dirigeants d'entreprise

Les normes en matière d'IA évoluent rapidement et les lacunes en matière de sécurité se développent au même rythme. Les entreprises qui agissent maintenant jetteront les bases d'une adoption sécurisée de l'IA à grande échelle.

Quatre actions peuvent aider les organisations à démarrer.

- Évaluer la posture de sécurité actuelle de l'IA : Évaluer les capacités de gestion des identités existantes par rapport aux exigences des agents d'IA.

- Planifier la mise à l'échelle : Concevoir des architectures d'identité capables de gérer des millions d'agents d'IA à l'échelle

- Devenez partenaire d’Okta : Tirez parti du cadre complet de sécurité de l’IA d’Okta pour créer une infrastructure d’IA sécurisée et évolutive.

- Commencez petit, puis passez à l'échelle supérieure : Commencez par des déploiements pilotes d'agents d'IA en utilisant Okta comme base, puis passez rapidement à l'échelle supérieure.

L'avenir de l'IA appartiendra aux entreprises qui innovent avec confiance. Okta est prêt à vous aider à sécuriser cet avenir.

Prêt à sécuriser votre infrastructure d'IA ? Contactez Okta pour savoir comment notre cadre de sécurité d'IA complet peut protéger les investissements de votre organisation dans l'IA et permettre une innovation sécurisée à grande échelle.