Alors que les Organizations ont commencé à explorer les opportunités de l'IA, le spectre de l'IA fantôme s'est également manifesté.

D'une certaine manière, cela ne devrait guère surprendre. Lorsque l'adoption du cloud a augmenté, l'utilisation non autorisée d'applications cloud, ou ce qu'on appelle « shadow IT », a également augmenté. Les applications de messagerie ? Terminaux personnels ? Ils continuent tous de contribuer à la demande d'authentification de relever le Shadow IT sur les réseaux Enterprise. Le Shadow IA est simplement la dernière itération d'un vieux problème.

Une situation de va-et-vient

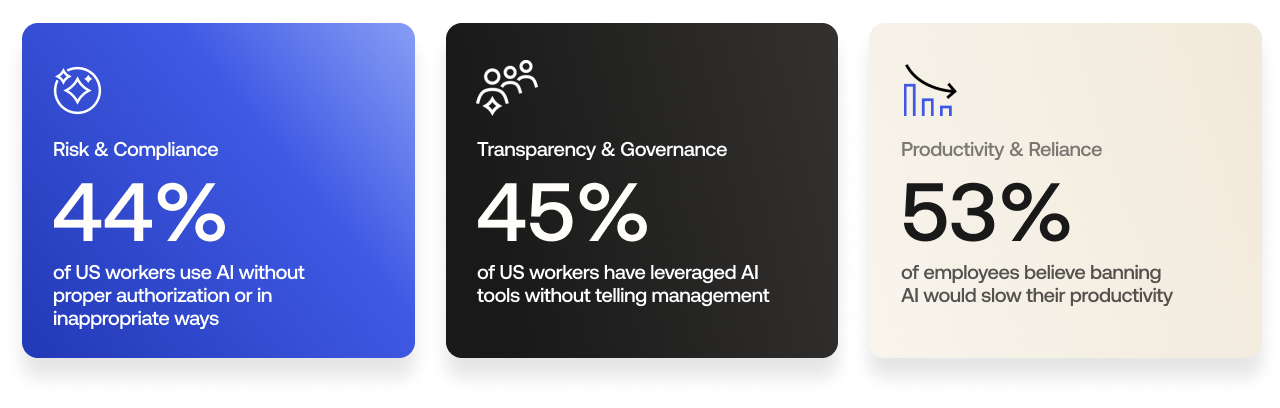

Alors que les outils d'IA inondent le marché et que de nouvelles start-ups émergent quotidiennement, l'adoption par les employés est inévitable, bien que l'adhésion aux outils et processus approuvés ne le soit pas. Une enquête de KPMG a révélé que 44 % des employés américains utilisent l'IA sans autorisation appropriée ou de manière inappropriée. Une autre étude de Gusto a indiqué que 45 % des travailleurs aux États-Unis ont utilisé l'IA au travail sans en informer leur employeur ou leur responsable, et 53 % ont estimé que leur productivité ralentirait si l'IA était interdite.

Cette réalité laisse les Organizations dans une situation de tiraillement — la pression d'adopter les gains de productivité de l'IA contre l'attraction de la sécurité et de la gestion des risques. L'IA non gérée peut introduire toutes sortes de problèmes, allant des résultats biaisés aux fuites de données et aux problèmes de conformité réglementaire.

Cependant, Bryan McGowan, Leader mondial de l'IA de confiance chez KPMG, explique que les employés se tournent souvent vers des outils non autorisés, car ils offrent une plus grande rapidité et une plus grande facilité d'utilisation par rapport aux alternatives approuvées.

« L'évolution des frameworks de gouvernance, des contrôles des risques et de la formation des employés a pris du retard par rapport à l'adoption de l'IA », note-t-il. « De plus, les Organizations ont du mal à trouver le juste équilibre entre les mesures de protection conçues en interne et celles offertes par les plateformes technologiques, telles que les hyperscalers. »

Ce manque de politique et de gouvernance aggrave la situation. Le rapport AI at Work 2025 d'Okta a révélé que seulement 36 % des Organizations disposaient d'un modèle de gouvernance centralisé pour l'IA. De plus, un examen plus approfondi des données de l'enquête a révélé que, lorsqu'on leur demandait quels étaient les éléments clés d'une adoption et d'une intégration réussies de l'IA, deux des trois principales réponses étaient « des processus et des garde-fous pour assurer la qualité des données » et « la gouvernance et la sécurité ».

Établir une gouvernance efficace de l'IA

« Les Organizations efficaces ont absolument besoin de la visibilité, de la définition de la politique et de la gouvernance qui découlent d'un modèle centralisé et descendant », note Ben King, Vice-président, Security Trust and Culture, chez Okta. « Une équipe ou un comité central peut définir l'utilisation des données, des politiques et des processus cohérents, et des garde-fous ; répondre aux attentes internationales et réglementaires ; inclure la sécurité et la confidentialité dès la conception ; et utiliser au mieux les ressources avec une visibilité complète des besoins et des cas d'usage dans toute l'organisation. »

Une gestion efficace des accès et de l'identité doit sous-tendre tout cela, en fournissant le niveau de contrôle et de visibilité dont les Organizations ont besoin. Les agents d'IA surpermissionnés, par exemple, peuvent exposer les Enterprise à des risques de sécurité et à des fuites de données. Mais en plus d'une focalisation descendante sur l'IAM, Organizations ont également besoin d'une culture d'innovation, d'expérimentation et de retour d'information venant de la base.

"Les employés doivent se sentir habilités à tester, à apprendre, à échouer, à itérer et à réessayer sans se sentir limités", explique M. King. "Il en résulte un modèle hybride où la visibilité et le contrôle centralisés existent, mais qui est conçu pour permettre et encourager l'utilisation innovante de l'IA."

La vraie question, poursuit-il, est de déterminer comment les Organizations devraient définir ce modèle et où fixer la limite. La réponse à cette question est une fonction de la maturité organisationnelle à travers les prismes de la technologie, du droit, de la confidentialité, de la sécurité et du risque sur les marchés où l'organisation opère.

« Une Organizations mature peut autoriser davantage d'expérimentations avec un contrôle moins défini, si la culture et l'éducation existantes des employés garantissent que les tests seront effectués de manière raffinée et sécurisée », déclare King. « En revanche, une organisation moins mature nécessitera des garde-fous plus robustes, des attentes explicites sur ce qui est acceptable et ce qui ne l'est pas, avec des comités de révision et d'approbation. »

Sortez l'IA de l'ombre en donnant les moyens d'agir aux employés

McGowan suggère que les Organizations mettent en place une fonction de laboratoires d'IA conçue pour promouvoir le développement standardisé et collaboratif de solutions d'IA. Son rôle principal, explique-t-il, est de créer et de partager des modèles de conception, des playbooks et une architecture d'IA uniforme dans toute l'entreprise.

« Cela fournit un environnement sécurisé et à faible risque où les employés peuvent expérimenter avec les outils et technologies d'IA — un sandbox qui permet un apprentissage pratique et des tests de défis réels avant que les solutions ne soient déployées plus largement », ajoute-t-il. « Il travaille également avec diverses équipes, clients et partenaires pour co-créer et tester des solutions d'IA, en veillant à ce qu'elles soient pratiques et efficaces, tout en aidant à aligner les nouvelles innovations du marché avec l'architecture d'IA établie de l'entreprise afin de maintenir la cohérence et la sécurité. »

« L'objectif est de favoriser une culture axée sur l'IA, de sorte que l'accès soit souvent accordé à un large éventail d'employés », explique McGowan. « Par exemple, chez KPMG, les ‘IA & Data Labs’ et leurs outils sont disponibles pour tous les employés américains, et des laboratoires spécifiques sont accessibles à tous les professionnels du conseil sur demande. » Cela encourage la littératie et l'innovation généralisées en matière d'IA. »

Selon McGowan, bâtir une culture de confiance dans l'IA nécessite une approche centrée sur l'humain, axée sur l'engagement, l'éducation et l'autonomisation. Pour favoriser cet environnement, ajoute-t-il, les Organizations devraient suivre les stratégies clés suivantes :

Instaurer la confiance et réduire la peur : répondre aux craintes courantes concernant l'IA en démystifiant les mythes et en étant transparent quant à son rôle. Créez des définitions claires « de-à » sur la façon dont les rôles évolueront, en mettant l'accent sur l'IA comme un outil pour augmenter le potentiel humain, et non pour le remplacer.

Donner aux employés les moyens d'agir et de développer leurs compétences : Offrir un accès à des outils d'IA sécurisés et à des environnements de type « sandbox » où les employés peuvent expérimenter sans risque. Offrez diverses options de Formation, telles que des hackathons pratiques, des sessions de Formation formelles et des parcours d'apprentissage à la demande, afin de renforcer la confiance et les compétences.

Suscitez l'engagement et l'inspiration : élaborez un récit stratégique clair de la part de la direction concernant la vision de l'entreprise en matière d'IA. Reconnaître et récompenser les employés pour avoir expérimenté et utilisé avec succès de nouvelles méthodes de travail alimentées par l'IA.

Rendre l'IA accessible et facile à utiliser : intégrez les outils d'IA de manière transparente dans les workflows quotidiens afin qu'ils deviennent une seconde nature. Créer un hub centralisé où les employés peuvent facilement trouver des outils, des ressources et des bonnes pratiques en matière d'IA.

« En mettant en œuvre ces stratégies, déclare McGowan, les Organizations peuvent amener leurs employés à un état de curiosité, d'inspiration et d'engagement à tirer parti de l'IA pour l'innovation et la croissance. »

Pour des recommandations sur le développement d'une stratégie de gouvernance de l'IA efficace, lisez Why your AI strategy is exposing you to risk — and what to do about it.