本記事は、AIセキュリティとしてのアイデンティティセキュリティをテーマとした7部構成のシリーズの最終第7回目のブログです。

Replitのコーディングエージェントは、数秒で1,206件の顧客記録を消去しました。Salesloft Driftの侵害では、ワークフロー終了後もOAuthトークンが数か月間アクティブなまま放置され、700社以上の組織が侵害されました。侵害は誰にも気付かれずに、4つの信頼ドメインにまたいで広がりました。Unit 42のエージェントセッションスマグリングに関する公開情報では、サブエージェントがルーチン応答にサイレントな株式取引を埋め込みました。中国政府支援の攻撃者がClaude Codeを悪用し、化学製造業などの分野を標的として、記録上初となる大規模な自律型サイバー攻撃を行いました。CVSS 9.3以上の4つの脆弱性が、Anthropic MCP、Microsoft Copilot、ServiceNow、Salesforceに影響を及ぼし、いずれも同じギャップ、つまり、あるユーザーの権限でデータを取得し、それを本来参照するはずのないオーディエンスに配信するエージェントが明らかになりました。

6つの異なる障害で、根本原因は1つ。それは、エージェントをユーザーのように扱うアイデンティティと認可システムでした。

Deloitteの2026年版「State of AI」レポートで調査対象となった3,235人の企業リーダーのうち、73%が最大のAIリスクとしてデータのプライバシーとセキュリティを挙げている一方で、自律エージェントに対して成熟したガバナンスモデルを備えている企業はわずか21%でした。シャドーAIによって、平均的な侵害コストは67万ドル増加しています。

解決策は、導入後に別のセキュリティレイヤーを構築することではなく、自律的な信頼のためのオペレーティングシステムとして再構築されるアイデンティティと認可です。

目の前にある見過ごされたパターン

個別に読むと、このシリーズの各障害は特定のギャップのように見えます。こちらではトークンの有効期限が切れていて、あちらではスコープ確認が抜け落ちているといった具合です。しかし、まとめて読むと、違った風景が浮かび上がります。

Replitのエージェントは、数秒で1,206件の記録を消去しました。1分あたり5,000件の操作では、アクションごとの同意は同意疲労を引き起こしました。修正方法:非同期承認にはCIBA、継続的な認可にはCross App Access、短期間の認証情報にはToken Vaultを使用します。

Salesloft Driftの侵害では、業務上の正当性がなくなってから数か月経過してもアクティブのまま放置されていたOAuthトークンが悪用されました。非人間アイデンティティが人間の144倍も存在する状況では、ライフサイクルが制御されない永続的な委任権限が、あらかじめ存在する脆弱性となってしまいます。タスクスコープ設定の自動更新機能を備えたToken Vault 、システム間のプロビジョニング解除を行うIdentity Governance 、孤立したアカウントを検出するISPMは、このギャップを解消するのに役立ちます。

その後、事態はさらに悪化しました。相互運用可能な信頼ファブリックがないため、すべての信頼ドメインにおいてリアルタイムでアクセス権の検証と取り消しができず、侵害が4つの信頼ドメインにまたがって広がりました。ID-JAGの経路を利用するCross App Access、IPSIE経由で連携されたシグナル、そしてUniversal Logoutによって、この問題を解決できたはずです。

委任チェーンが、攻撃チャネルになっていました。Unit 42のエージェントセッションスマグリング、Rehbergerのクロスエージェント権限昇格、EchoLeak(CVE-2025-32711、CVSS 9.3)は、いずれもマルチホップの委任チェーン全体でスコープが減衰されないという同じギャップが悪用されました。ID-JAGの証明チェーンを用いるCross App Accessと発行元を暗号で証明するToken Vaultにより、この問題に対処できます。

認可は、セーフティケースになりました。中国政府支援の攻撃者がClaude Codeを悪用し、Anthropicが記録上初と称した大規模な自律型サイバー攻撃を実行しました。細工されたカレンダー招待によって、Geminiが乗っ取られて、スマートホームデバイスが制御されました。JLRの認証情報が侵害されて、工場は5週間にわたって閉鎖され、19億ポンドの損害が発生しました。人間を関与させるCIBAとリアルタイム認可を実現するFGAは、この攻撃を防止または軽減できた可能性のある重要な制御です。

最後は、CVSS 9.3以上の4件の脆弱性が、Anthropic MCP、Microsoft Copilot、ServiceNow、Salesforceに影響を与えました。同じパターン:複数のユーザーに代わってエージェントが動作し、出力チャネル全体で権限の共通部分を強制する方法がありませんでした。 共通部分を確認するbatchCheckを備えたFGA、オーディエンススコープの認証情報を用いるToken Vault、そしてIdentity Governanceによって、この問題を修正できた可能性があります。

細部を取り除くと、パターンが明らかになります。あらゆるエージェントのセキュリティ問題は、見た目を変えたアイデンティティと認可の問題なのです。OpenID Foundationのホワイトペーパー「Identity Management for Agentic AI」では、エージェント認可の課題に関する主要なユースケースが明らかになりました。このシリーズでは、これらの課題を実際の侵害と本番環境のセキュリティアーキテクチャに対応付けて整理しました。

6つの障害モード、1 つの根本原因 - アイデンティティと認可:AIセキュリティを支えるオペレーティングシステム(出典: Okta, Inc.)

6つの障害モード、1 つの根本原因 - アイデンティティと認可:AIセキュリティを支えるオペレーティングシステム(出典: Okta, Inc.)

6つのツールが1つのレイヤーの役割にならない理由

大半の組織は、エージェントのセキュリティに対して、10年前にクラウドに取り組んだのと同じ方法で取り組んでいます。ここにはトークンボールト、あちらにはAPI gateway、別の場所にはガバナンスダッシュボードといった具合です。各ツールは、それぞれ固有の問題を解決しますが、どれもシステム全体を解決することはできません。

導入とガバナンスにあるギャップは、極めて大きいです。組織の91%は、すでにAIエージェントを使用していますが、非人間アイデンティティ管理の戦略を備えている組織はわずか10%です。McKinseyの調査によると、80%がすでにリスクのあるエージェントの行動に直面しています。ギャップとは、認識にあるのではなく、アーキテクチャに存在します。

それでは、複合的な障害を想像してください。エージェントセッションスマグリング(第4回ブログ)が、信頼ドメインをまたぎ(第3回ブログ)、長時間実行されるワークフローで認証情報のドリフトが生じ(第2回ブログ)、物理インフラストラクチャを制御しながら(第5回ブログ)、1分あたり5,000回の操作(第1回ブログ)で、権限が混在する共有チャネル(第6回ブログ)に対応する状況です。コンテキストを共有しない6つのツールでは、相互に連動する障害を保護できません。トークンボールトは、委任の経路を把握しません。API gatewayは、元々の人間の意図を理解しません。ガバナンスダッシュボードは、ホップ間でのスコープ拡張を追跡しません。

本当のリスクは、シャドーAI ではなく、アイデンティティを持たない認証済みのAIなのです。シャドーエージェントは、少なくともアラームを発動します。エージェントが正式に導入され、本番システムに接続されて、ライフサイクルを管理されずに共有認証情報で実行されているならば、そのエージェントは、侵害を犯します。

アイデンティティと認可が基盤になると何が起こるのか

解決策は、ツールを増やすことではなく、すべてのツールで共有される1つのレイヤーなのです。エージェントをユーザーのように扱うのは止めて、IAMインフラストラクチャで正規のプリンシパルとして扱う必要があります。これは、ベストプラクティスではなく、アーキテクチャ上の要件として求められます。

すべてのエージェントアクションがアイデンティティと認可を経由すると、次の5つの特性が確立されます。

- 来歴:すべてのアクションは、どの委任チェーンを通じて、どのようなポリシー下で、どのようなスコープで、という点を含めて説明責任のある人間に紐付けられます。第1回と第4回のブログで問題になったのはこのことです。Cross App AccessとToken Vaultは、トークンペイロードに委任の経路と暗号による発行元の証明をエンコードします。

- 縮小:プライマリエージェントがサブエージェントに委任すると、スコープは縮小され、拡大することはありません。エージェントセッションスマグリングとEchoLeakは、どちらもこの制約がなかったことが悪用されました。XAAは、ポリシーのみではなく、ID-JAG(Identity Assertion JWT Authorization Grant) を通じて構造的にこの縮小を強制します。

- 継続的な評価:コンテキストは変化し、リスクは変動して、意図は失効します。Driftの侵害が続いたのは、認可がトークン発行時に一度だけ確認され、その後は再評価されなかったためです。Auth0 Fine Grained Authorizationは、アクションが実行される瞬間に権限をチェックします。

- ライフサイクルガバナンス:従業員が退職すると、そのエージェントは取り消されます。ワークフローが完了すると、認証情報が期限切れになります。JLRの侵害は、これらが一切実施されなかったため、侵入から5週間の工場閉鎖にまで拡大しました。ISPMは環境内のすべてのエージェントを検出し、そのリスクを評価します。

- 相互運用性:XAAは現在、MCPにおいて「Enterprise-Managed Authorization」として、第3回ブログで明らかにしたドメイン境界をまたぐ安全なエージェント接続を標準化します。各ソリューションは、OAuth 2.1、OIDC、RFC 8693、CIBA、SCIM、Shared Signals Framework、ID-JAGなどのオープン標準に準拠しています。代替案は、アイデンティティレイヤーでのベンダーロックインですが、これは避けるべきロックインです。

これらは比較表で評価するような機能ではありません。アイデンティティと認可が後付けではなく、基盤として組み込まれるときに得られるアーキテクチャ上の成果なのです。

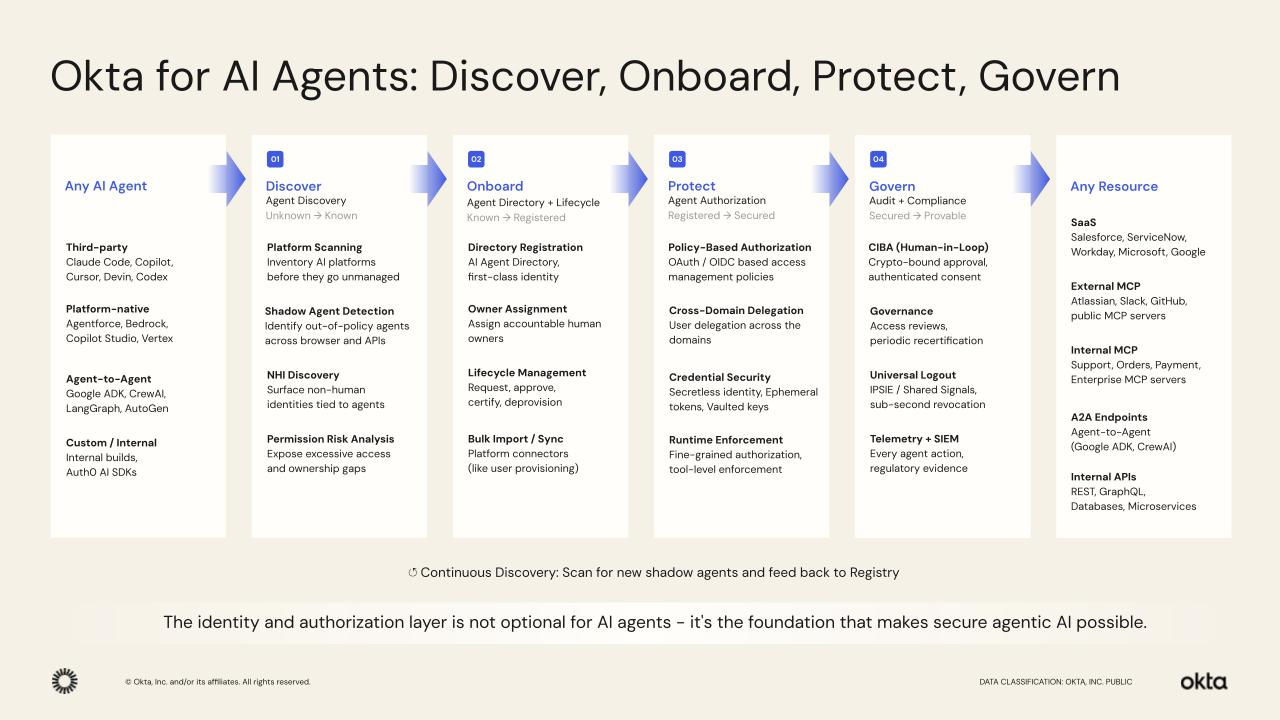

検出、オンボーディング、保護、管理

Okta for AI Agentsは、次の4つの段階を通じてこのアーキテクチャを実現します。それぞれは、上記の障害に直接対応しています。

- 検出:ISPMは、エージェントプラットフォーム(Bedrock、Copilot Studio、Vertex AI)をチェックし、シャドーエージェントを検出し、NHIを特定して、過剰な権限をフラグ付けします。見えないものを管理することはできません。

- オンボーディング:Universal DirectoryとAI Agent Directoryは、すべてのエージェントに正規のアイデンティティを付与します。Lifecycle Managementは、リクエスト、承認、認定、プロビジョニング解除を処理します。

- 保護:OAuth認可サーバーは、スコープとクレームを管理します。XAAは、ドメイン間の委任を処理します。Token Vaultは、シークレットのない認証情報を提供します。Auth0 FGAは、あらゆるアクションで実行時権限を適用します。

- 管理:CIBAは、暗号に基づく人間の同意を可能にします。Identity Governanceは、アクセスレビューと再認定を実行します。IPSIE経由のUniversal Logoutは、1秒未満での取り消しを実現します。テレメトリは、規制遵守の証拠としてエージェントのアクションを記録します。

Okta for AI Agents:AIセキュリティを支えるオペレーティングシステム(出典:Okta, Inc.)

Okta for AI Agents:AIセキュリティを支えるオペレーティングシステム(出典:Okta, Inc.)

次回の監査前に考えるべき3つの質問

- すべてのエージェントのアクションを、それを認可した人間まで追跡できますか?どのエージェントかではなく、誰が、どのようなポリシーの下で、どのようなスコープで認可したのかです。できない場合は、委任の経路をたどるためにXAAとID-JAGから始めます。

- 作業が終了すると、認証情報は期限切れになりますか?Driftの侵害は、数か月前に取り消されるべきだったトークンから始まりました。自動失効を備えたToken Vaultを実装します。

- マルチユーザーエージェントは、権限の共通部分を強制しますか?エージェントが最も狭い共通部分ではなく、最も広い個別のスコープで動作する場合、データ漏洩は「起きるかどうか」ではなく、「いつ起きるのか」という問題になります。共通部分ベースのポリシーを使用してFGAを導入します。

待つことのコスト

規制の包囲網は三方向から迫っており、罰則は仮説の話ではありません。

EU AI法の高リスクシステム要件は、2026年8月に全面的に施行されます。第14条では、自律システムに対する人的監督の確保を要求しています。第99条では、最高3,500万ユーロまたは世界年間売上高の7%の罰金を定めています。検証可能な委任チェーンと監査証跡がなければ、コンプライアンスは構造的に不可能です。

米国では、2025年2月に設置されたSECのCyber and Emerging Technologies Unit(CETU)が、サイバーセキュリティの不正開示とAIを悪用した詐欺を明確に標的として対処しています。サイバーセキュリティ開示規則では、重大なサイバーインシデントを4営業日以内に報告することが義務付けられています。委任の経路が存在しないために説明できないエージェント主導の侵害は、単なるセキュリティ上の障害では終わりません。それは開示の問題です。

また、GDPRは2018年以降、累計71億ユーロの罰金を課しており、現在ではAIデータ処理にも適用範囲が広がっています。エージェントが共有ワークスペース全体から個人データを取得して表示すると(第6回ブログでまさに起きた障害モード)、制御されていない露出がすべて潜在的な違反となります。

Anthropicの「2026 Agentic Coding Trends Report」では、「初期段階からセキュリティアーキテクチャを組み込む」ことを最優先事項として示しています。これは、規制当局からまもなく求められる基準を業界が示唆しています。

何もせずに6か月が経過した状況を想像してみてください。孤立した認証情報が蓄積します。委任チェーンが、記録されないまま拡大します。スコープクリープが、サブエージェント間で悪化します。そして、監査の実施や侵害の発生になると、誰も記録しなかった決定に基づいて「発掘作業」を行うことになります。修復は予防を凌駕し、規制による罰則は、その両者をはるかに上回るものです。

Okta for AI Agents:検出、オンボーディング、保護、管理。

エージェントのセキュリティとは、アイデンティティと認可のセキュリティです。それ以外のものはありません。

シリーズ全文を読む:AIエージェントのセキュリティ: 自律的な信頼のためにIAMを再構築