このブログはこちらの英語ブログの機械翻訳です。

すべてのビジネスリーダーが「 AI を活用して競争力を高めるにはどうすればよいか」と問いかけています。セキュリティ リーダーは、「数千もの自律的で目に見えないセキュリティ リスクを生み出すことなく、どうすれば AI を導入できるか」という、別の質問をしています。

2万を超えるグローバル組織のセキュリティ保護を支援してきた私たちの視点から、この課題がリアルタイムで展開されているのがわかります。ジェネレーティブAIとエージェントAIの台頭により、非人間アイデンティティ(NHI)が爆発的に増加しています。これらのAIエージェントは、機械の速度で動作し、機密データにアクセスし、重要なAPIを呼び出し、ユーザーに代わって意思決定を行うことができます。

これは、根本的なアイデンティティの危機を生み出します。予測可能な人間主導のアクセス向けに設計された従来のIAMシステムは、この現実に対応できません。最新のアプローチがなければ、企業は盲点に直面します。どのエージェントが何にアクセスできるのか?それらの権限は適切ですか?侵害されたエージェントが損害を引き起こす前に、どのようにして停止しますか?

AIの未来を守るには、アイデンティティが不可欠です。この記事では、MCP、A2A、RAGなどの新たなAI標準とフレームワークが、どのように新しい機能を実現すると同時に、重大なセキュリティ上の課題をもたらすのか、そして、なぜこれらの課題の解決にアイデンティティを最優先とするアプローチが必要なのかを探ります。

誰が AI を採用しているのでしょうか?そして、なぜ AI を採用しているのでしょうか?

業界全体で、組織は主に3つの方法でAIの導入を進めています。

従業員のためのAI:多くの企業が従業員の能力を強化するためにAI技術を導入しています。成功は、信頼できるベンダーを獲得し、AIプラットフォームが企業内で獲得する増大するアクセスを管理することにかかっています。

B2BパートナーシップにおけるAI:一部の組織は、AIをパートナーまたはベンダー向けのサービスに組み込んでいます。彼らの優先事項は、迅速なTime-to-Valueと、AI機能をサードパーティに安全に公開することです。

AIネイティブのプロダクトビルダー:これらの企業は、他の企業が評価しているAI搭載製品を開発しています。彼らはイノベーションに重点を置き、強力なセキュリティフレームワークに依存して、本番環境での信頼を確保しています。

3つのグループすべてにおいて、ニーズは一貫しています。それは、AIの導入に合わせて拡張できるセキュリティです。

AIエコシステムにおける進化する標準

AIエコシステムは、標準化に向けて急速に動いています。多くのプロトコルが提案されていますが、近い将来のエンタープライズへの影響という点で、Model Context Protocol(MCP)、エージェント間通信(A2A)、および検索拡張生成(RAG)の3つが際立っています。

MCP:コンテキスト指向プロトコル

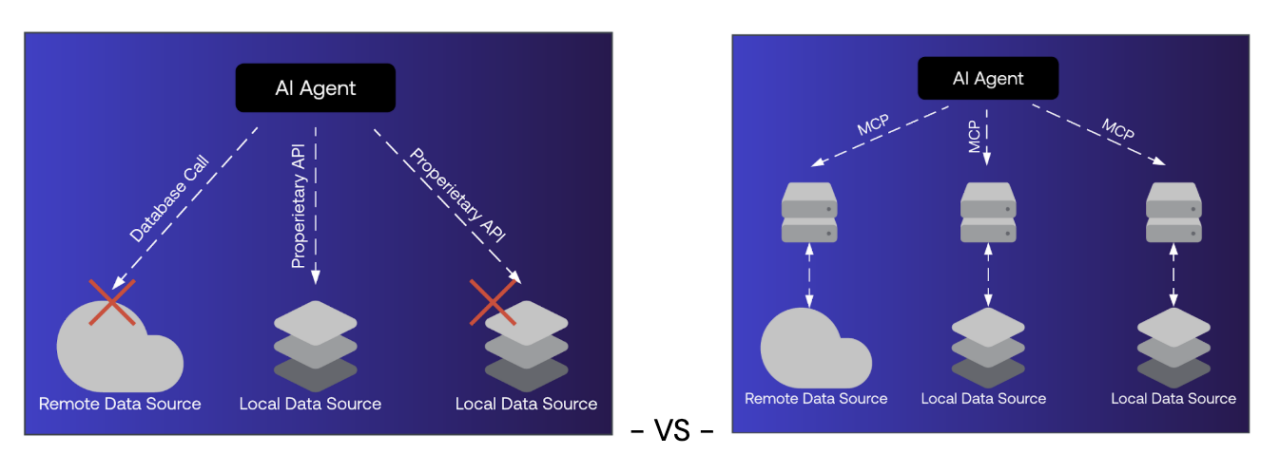

Anthropic によって開発された MCP は、AI モデルと外部システム間のユニバーサル翻訳機として機能します。MCP は、エージェントが各 API の特性に適応することを要求する代わりに、ツールやリソースにアクセスするための一貫したプロトコルを提供します。

たとえば、CEO は AI アシスタントに、CRM、在庫システム、および会計プラットフォーム全体の販売データを分析するように依頼する可能性があります。MCP を使用すると、アシスタントはカスタム統合を必要としません。共通の標準を通じて各システムと対話できます。MCP は、AI エージェントをユニバーサルツールベルトに変えます。

セキュリティへの影響は重大です。MCP によりアクセスがより簡単になり、一貫性が高まりますが、認証と承認の重要性も高まります。OAuth 2.1 は仕様の一部ですが、エージェントのオンボーディングとなりすましのリスクの動的でタスク駆動型の性質には完全には対応していません。

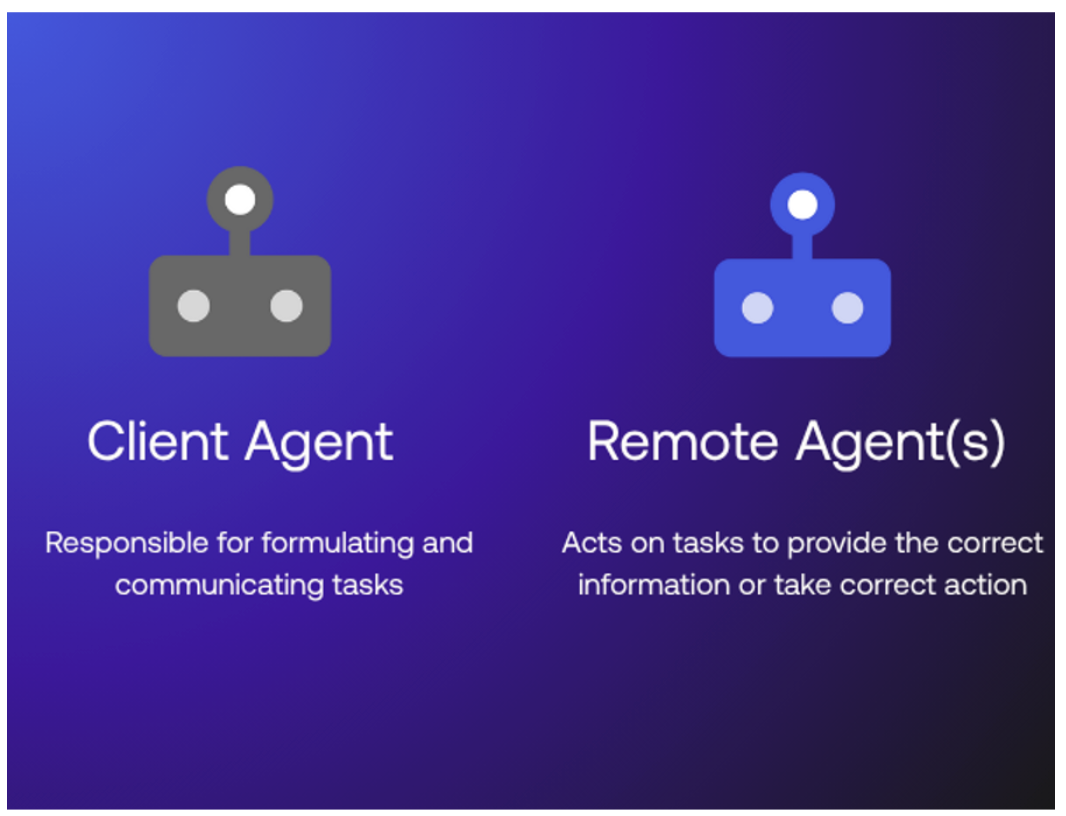

A2A:エージェント間プロトコル

MCPが個々のエージェントを装備する場合、A2Aはエージェントが連携して作業できるようにします。A2Aは、エージェントの機能を記述するために標準化された「エージェントカード」を提案するGoogle Cloudの新興フレームワークです。これらのカードにより、エージェントは作業を分担し、タスクを調整し、複雑な目標について共同作業を行うことができます。可能性は明らかです。サプライヤー、荷送人、小売業者を代表するAIエージェントがリアルタイムで連携して、サプライチェーンの混乱を解決することを想像してみてください。

セキュリティ上の課題も明らかです。強力なアイデンティティ制御がなければ、A2Aはなりすまし、傍受、または悪意のあるコラボレーションのチャネルになる可能性があります。Cloud Security AllianceのMAESTROフレームワークを使用した脅威モデリングでは、エージェントが信頼できるエンティティを装ったり、サーバーが正当な参加者を装ったりするなどのシナリオがすでに特定されています。

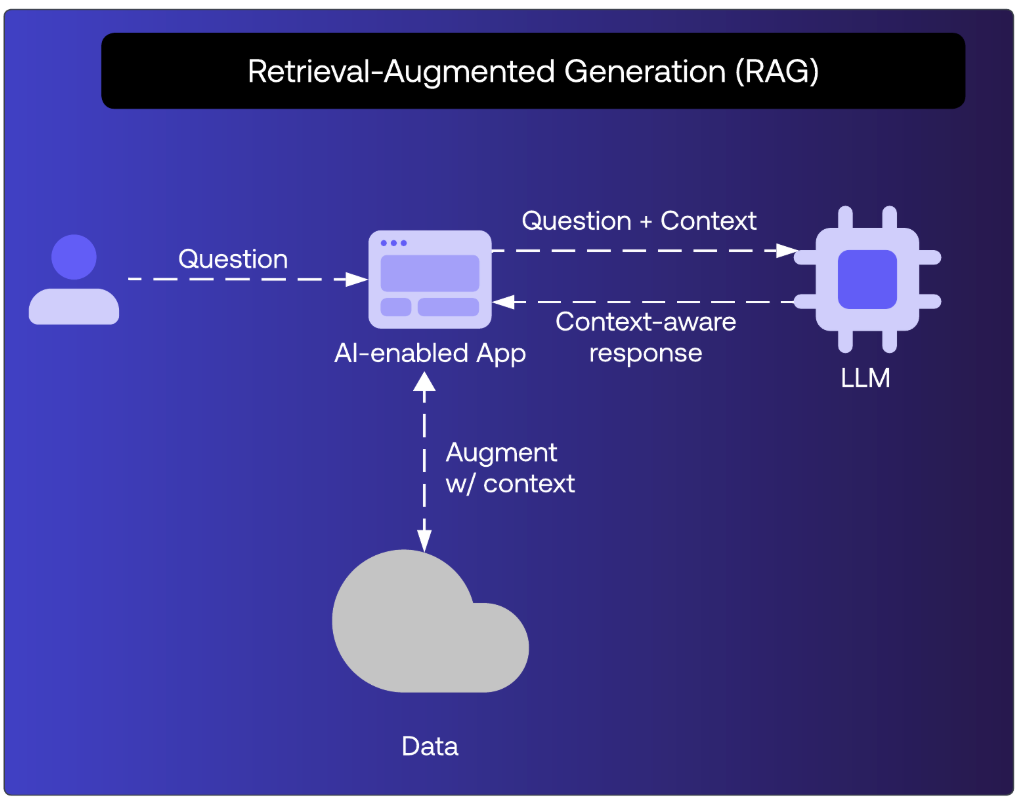

RAG:プロトコルではなくフレームワーク

生成AIモデルは強力ですが、その知識はトレーニングデータに限定されています。Retrieval-Augmented Generation(RAG)は、応答を生成する前にライブソースから情報を取得することで、それらを強化します。これにより、出力が正確で最新であり、エンタープライズデータに基づいていることが保証されます。

CFOが第4四半期の予算実績について質問することを考えてみましょう。RAGのないモデルは、古くなっているか、捏造された回答を提供する可能性があります。RAGを使用すると、モデルは最初に会社の実際のシステムにクエリを実行し、次に検証済みの数値で応答します。

RAGはエンタープライズの信頼にとって重要ですが、承認に関する課題も生み出します。RAGパイプラインには、多くの場合、膨大なデータセットが含まれており、エージェントがアクセスする必要のあるデータセットのどの部分を決定するかには、きめ細かいリアルタイムの制御が必要です。

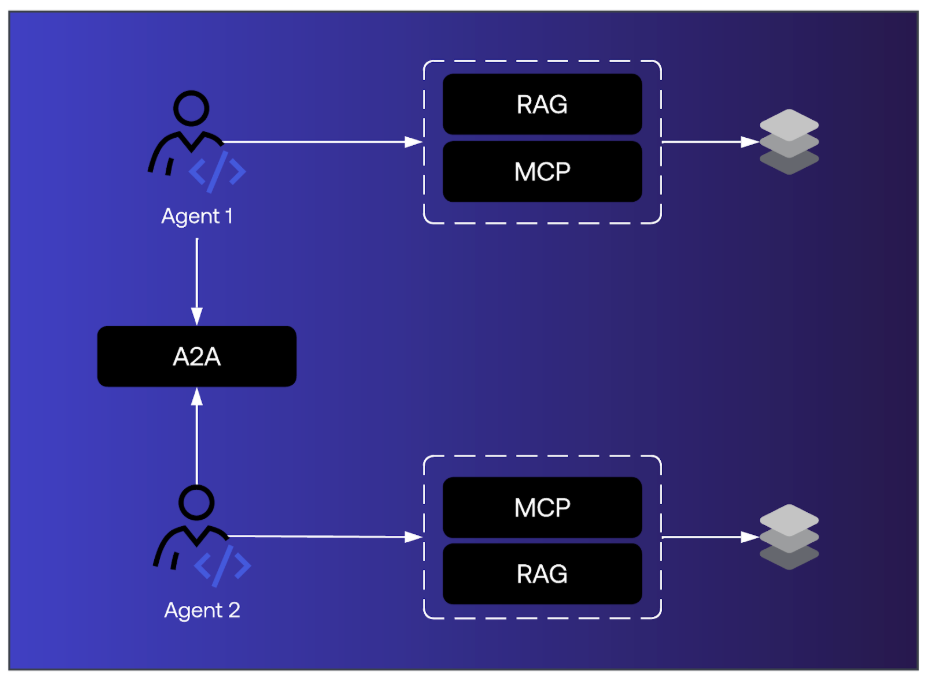

すべてをまとめると:触媒およびリスクの増幅器としての標準

MCP、A2A、RAGはそれぞれ、AIエージェントの機能を拡張します。これらが連携して、エージェント型AIエコシステムのバックボーンを形成します。

しかし、その採用はリスクも増幅させます。NHIssは、現在のIAMシステムが管理できないペースで増加しています。エージェントは、自律的、予測不可能、かつ大規模に行動します。アイデンティティを中心としない場合、企業はAIの利点を損なう可能性のあるセキュリティリスクに直面します。

標準がどのように新しいセキュリティの考慮事項を生み出すか

組織は、サービスアカウントやAPIキーなどのマシンアイデンティティに長年苦労してきました。これらは、特権過多になったり、孤立したりすることが多く、ガバナンスの盲点が生じます。

Agentic AIは問題を拡大させます。企業は、数百のアカウントを管理する代わりに、まもなく数千のエージェントを管理するようになり、それぞれが独自に動的な権限を持つようになります。これは、規模だけでなく、種類の変化を表しています。現在のIAMフレームワークは、このレベルの複雑さのために設計されたものではありませんでした。

標準によって生じるギャップ

MCPは、エージェントに新しいIDおよびアクセス管理の課題をもたらします。MCPは、エージェントがエンタープライズツールおよびシステムにアクセスするための標準化された方法を提供することにより、相互運用性を向上させます。同時に、新しいIDの課題も導入します。従来のIAMフレームワークは、アクセスパターンが動的でタスク駆動型であるAIエージェントを認識、認証、および承認するのに苦労します。

MCP を使用して複数のシステムを照会できるエージェントは、最初に安全にオンボードされ、継続的に検証される必要があります。これらの保護手段がなければ、MCP を強力にするのと同じ効率が、不正アクセス、不正な動作、または悪意のあるエージェントによるなりすましのリスクも高めます。

A2Aは、エージェント間の信頼と安全な通信に新たなリスクをもたらします。A2Aの約束は、自律エージェント間のシームレスなコラボレーションです。現実は、強力なIdentity基盤がなければ、すべての新しい接続が潜在的な脆弱性になるということです。

エージェントが機密データを交換し、タスクを調整する際に、攻撃者は信頼できるエージェントになりすましたり、メッセージを傍受したり、やり取りを操作したりする可能性があります。A2A脅威モデリングでは、正当な企業を装った悪意のあるサーバー、盗まれたエージェントの認証情報、不正な信頼のエスカレーションなどのリスクがすでに強調されています。A2Aがコンセプトからエンタープライズでの採用に移行するためには、多様なエージェント間の安全な通信と検証可能なアイデンティティの確立が不可欠です。

RAGは、データの正確性と情報開示のリスクを高める新しいアクセスパターンを作成します。RAGは、エンタープライズデータに基づいて出力をグラウンディングすることにより、ハルシネーションを減らしますが、そうすることで複雑な認証要件が導入されます。RAGを搭載したAIシステムは、大規模なデータストア全体をクエリする必要がある場合があります。

これらのストアのどの部分をどのエージェントがどのコンテキストで利用できるかを決定するには、現在ほとんどの企業が適用しているものよりもはるかにきめ細かい承認が必要です。これらの制御がない場合、エージェントは機密情報を公開したり、コンプライアンス基準に違反する出力を生成したりする可能性があります。企業が RAG パイプラインを拡張するにつれて、リアルタイムできめ細かいアクセス決定を強制する機能は、機能ではなくセキュリティ要件になります。

企業が抱えるより広範な課題

AIエージェントがより自律的な行動をとるようになるにつれて、企業は各ステップを開始したのが誰(または何)であるかを正確に知る必要があります。それは人間が直接リクエストしたのか、それともエージェントが数時間後にそのユーザーに代わって行動したのか?

明確な帰属がないと、フォレンジック調査が停滞し、コンプライアンスレポートが信頼できなくなります。説明責任の欠如は、組織が自律的な意思決定に対する管理を実証するのに苦労するため、信頼を弱めます。

AIシステムは、特にデータポイズニング、モデル反転、プロンプトインジェクションなどの手法に対して脆弱です。これらの攻撃は、エージェントの動作を操作したり、機密情報を抽出したりするように設計されています。

システムが相互に通信し、互いの出力を基に構築するエージェントエコシステムでは、1つの侵害されたエージェントが多くのドメインにリスクを拡散させる可能性があります。敵対的な戦術から保護するには、エンドポイントセキュリティと、エージェントの動作の継続的なアイデンティティベースの監視が必要です。

AIエージェントは、多くの場合、長時間実行されるタスクで動作します。AIエージェントは、一度承認を要求した後、人間が移動した後もアクションを実行し続ける場合があります。これにより、承認疲労(ユーザーが精査せずに繰り返し表示されるプロンプトをクリックする)や、コンテキストの喪失(エージェントが正確に何をする権限を与えられているかが不明確になる)などのリスクが生じます。適切なタイミングで人間をループに再導入するメカニズムがないと、企業は説明責任を失い、不正な行為にさらされるリスクがあります。

OAuthフレームワークは、ユーザーがクロスプラットフォームアクセスを許可することでアプリケーションを接続することを長年可能にしてきました。消費者環境では、エンドユーザーが接続を所有および制御するというこの仮定は理にかなっています。企業では、そうではありません。

企業は、個々の裁量ではなく、ポリシーによってこれらの接続を承認する必要があります。AIがスケールするにつれて、アプリケーション間およびエージェントからアプリケーションへの接続の数が劇的に増加し、今日すでに存在する問題を悪化させます。集中管理がないと、セキュリティチームは、エージェントが作成するアクセス許可のスプロールメッシュに気づかなくなります。

OktaはどのようにしてエージェントAIを保護するのか

IdentityはAIセキュリティの基盤でなければなりません。Oktaのプラットフォームは、ヒューマンとNHIの両方を管理し、MCP、A2A、およびRAGによって導入されたギャップに対処します。

Oktaの包括的なAIセキュリティフレームワーク

Okta は、人間 ID を管理するのと同じ方法で、AI エージェントを検出、オンボード、管理、および監視できます。ポリシーは、可視性、説明責任、およびエンタープライズ標準との整合性を確保するのに役立ちます。

認証前、認証中、認証後のセキュリティ

- 認証前: 企業はエージェントアクセスに関する洞察を得て、ポリシー主導のオンボーディングを適用します。

- 認証時:アクセス決定はコンテキスト依存です。エージェントはエンタイトルメントを持っている可能性がありますが、ポリシーによって特定シナリオでそれらを実行できるかどうかが決まります。

- 認証後:継続的な監視により、継続的なコンプライアンスが可能になります。リスクが検出された場合、Oktaはトークンを失効させたり、SOCチームに通知したり、修復を自動化したりできます。

AIセキュリティのためのOktaの機能

クロスアプリアクセス(XAA):エージェントAI向けに調整されたOAuthの拡張機能であるXAAは、アプリ間およびエージェント駆動型の接続の監視を一元化し、企業が反復的なユーザー承認に頼ることなくポリシーを適用できるようにします。

認証共有の防止:OAuth2 Demonstrating Proof-of-Possession (DPoP) と OAuth 2.0 Mutual-TLS Client Authentication (mTLS) のサポートを通じて、Okta はトークンが盗まれたり再利用されたりしないようにします。トークンを受信するエージェントのみがそれを使用できます。

OktaトークンVault(MCPブローカー):AIアプリケーションを構築する開発者は、多くの場合、多くの外部サービスに接続する必要があります。Token Vaultは、ユーザートークンを安全に保管し、MCPブローカーとして機能し、大規模な統合を簡素化します。

セキュアなA2Aアクセス。トークン交換により、Oktaは、ヒューマンアイデンティティから始まり、複数のエージェントを介して拡張される委任された承認チェーンをサポートし、精度と監査可能性を維持します。

非同期検証。OAuth2 のクライアント開始バックチャネル認証フロー(CIBA)を使用して、Okta は長時間実行されるエージェントプロセスに対して安全な人間の承認を可能にし、説明責任と効率のバランスを取ります。

RAGのためのきめ細かい認可。OktaのFGAソリューションは、クエリレベルでリアルタイムの認可を適用し、AIエージェントがユーザーに表示する権限のあるデータのみにアクセスできるようにします。

OktaがAIセキュリティをリードする理由

OktaはすでにAIアイデンティティの課題に対するソリューションを提供しています。

- ファーストムーバーアドバンテージ:AIエージェントのID管理は、ロードマップ上ではなく、現在利用可能です。

- エンタープライズ規模:毎月数十億のログインを管理する20,000を超えるお客様から信頼されています。

- 標準リーダーシップ:MCPやA2Aなどの新興AIセキュリティ標準への積極的な参加。

- 包括的なプラットフォーム:現在および将来のAIセキュリティの課題に対処するアイデンティティ、ガバナンス、および認可

Auth0 for AI AgentsやXAAのような新しいイニシアチブを通じて、OktaはAIエージェントとそのインタラクションのユニークな要件を満たすために、そのアイデンティティフレームワークを拡張しています。

企業リーダー向けの次のステップ

AI標準は急速に進化しており、セキュリティギャップも同じペースで拡大しています。今すぐ行動する企業は、大規模な安全なAI導入の基盤を確立します。

組織が開始するのに役立つ4つのアクション。

- 現在のAIセキュリティ体制の評価:既存のアイデンティティ管理機能をAIエージェントの要件に照らして評価します。

- 規模を考慮した計画: 数百万の AI エージェントを大規模に処理できるアイデンティティアーキテクチャを設計する

- Oktaとの連携:Oktaの包括的なAIセキュリティフレームワークを活用して、安全でスケーラブルなAIインフラストラクチャを構築します。

- 小さく始めて、スケールアップ:Oktaを基盤として、パイロットAIエージェントの展開から始め、迅速にスケールアップします。

AIの未来は、自信を持って革新する企業のものになります。Oktaは、その未来を保護する準備ができています。

AI インフラストラクチャを保護する準備はできていますか?Okta にお問い合わせいただき、当社の包括的な AI セキュリティフレームワークが組織の AI 投資を保護し、大規模な安全なイノベーションをどのように実現できるかをご確認ください。