前回の記事では、爆発的に増加する「非人間アイデンティティ(NHI)」の管理に焦点を当て、システム間連携や自動化ツールの安全性を確保する重要性を解説しました。

しかし、現代のアイデンティティ環境において、NHIという枠組みを超えて「自律的」に動き始めている存在があります。それが、「AIエージェント」です。

従来のNHIが、あらかじめ定義されたルールに従ってシステム間を繋ぐ「静的な仕組み」であったのに対し、AIエージェントは自ら考え、判断し、人間のように業務を遂行する「動的なアイデンティティ」へと進化しています。この「意思を持つNHI」とも言える存在を、いかに安全に組織へ受け入れるべきか。今回は、AIエージェントを「人と同等に」管理するための具体的な手法について詳しく解説します。

AIエージェントという「第3のアイデンティティ」

AIはもはや単なるチャットボットではなく、「人間と同等に」扱うべき強力な新種のアイデンティティとして企業内に存在しています。企業で働く人々は、メール、Zoom、Slack、Teamsなど、役割に応じて多種多様なアプリケーションを使用しており、権限の組み合わせは指数関数的に増えています。人間と同様のアイデンティティ管理が不可欠になっている今、自律的に動くAIエージェントもその管理対象として位置づけなければならないのです。

Oktaでは、AIセキュリティの確保はアイデンティティセキュリティと切り離せないと考えています。AIエージェントの時代に突入した今、セキュリティリスクとして起こり得るのは、許可されていないアクセスや、過剰に付与された権限、コンプライアンスと監査のギャップ、不十分な権限管理、シークレットや資格情報の漏えい、データプライバシーリスクなどです。いずれも「誰がどこまでできるのか」という権限・制御・データ管理の問題に帰結するからです。

人とAIエージェントの間に生じる「権限の不一致」

具体的なシナリオで考えてみましょう。多くの企業では、見積もりシステムや在庫情報管理システム、配送サービスといった社内システムが存在しています。社員がこれらのシステムに直接アクセスする場合、ユーザー名とパスワード、MFA、端末確認、ネットワーク確認など、認証基盤プラットフォームによる認証と認可の制御がしっかり適用されています。

一方、AIエージェントを活用する場合はどうでしょうか。「今ある在庫から最短で発送可能なものをリストして、見積もりを作ってください」とチャットで依頼すると、企業内のAIエージェントが見積もりシステムや在庫情報、配送サービスに能動的にアクセスします。しかし、このAIエージェントが各サービスに対して「何をどこまでできるのか」という制御は、現状ほとんど行われていません。

さらに深刻なのは、シークレットや特権アカウント、APIキーといった強力な権限を持つ認証情報をAIエージェントに保持させているケースが非常に多いという点です。つまり、ユーザーが直接業務を行う際には適切なポリシーが適用される一方で、AIエージェントを経由するとユーザーの権限以上のことができてしまうという「権限の不一致」が生じているのです。この問題は「Confused Deputy Problem」とも呼ばれ、権限の不一致に起因する事故も急増しています。

4段階の管理アプローチを実現する「Okta for AI Agents」

この課題に対応する新サービスが「Okta for AI Agents」です。Okta for AI Agentsは、AIエージェントと企業のアプリケーションの間にセキュリティレイヤーを設け、一貫した企業ポリシーを適用するというものです。

Oktaのプラットフォームは「Identity security fabric」というアプローチに基づき、従業員や顧客、パートナーといった人間のアイデンティティ管理に加え、サービスを管理するためのアカウントや自動化ツールのアカウントといった「非人間アイデンティティ(NHI)」も保護対象としてきました。今回、その対象に「AIエージェント」も含める形で機能を拡張しました。

AIエージェントのライフサイクル管理における4つの段階は以下の通りです。これらは人間に対して適用してきたセキュリティ管理の考え方をそのまま拡張したものであり、「人間と同等に扱う」という原則が一貫して貫かれています。

可視化:企業内に存在するAIエージェントをすべて把握します。

登録:把握したAIエージェントを企業のアイデンティティとして登録します。

制御・保護:登録されたAIエージェントに対して、企業のポリシーを適用します。

統制:継続的に監査を行いながら、権限を管理し続けます。

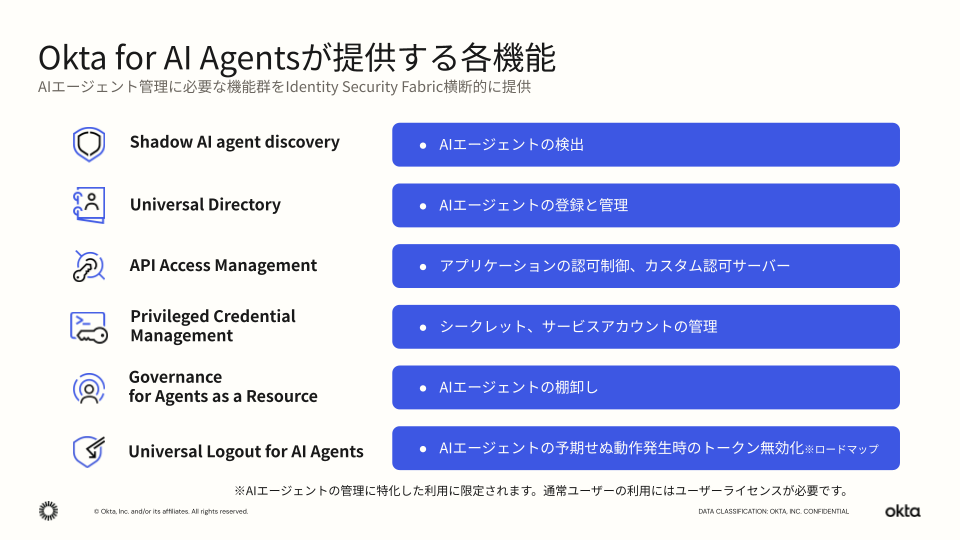

Okta for AI Agentsは、この4段階を実現するために以下の機能群を提供します。

- 「可視化」を担う「Shadow AI agent discovery」:可視化には2つのアプローチがあります。1つ目はブラウザプラグインによる検出です。Oktaのプラグインを導入することで、管理者が把握していないAIエージェントへの認可同意画面を検知し、利用状況を観測します。2つ目はAPI連携による検出です。SalesforceのAgentforceやMicrosoftのCopilot Studioといったプラットフォームと直接連携し、社内で作成・利用されているエージェントを自動的に検出します。

- 「登録」を担う「Universal Directory」:検出されたAIエージェントは、人間やサービスアカウント(NHI)と同様にUniversal Directoryへ登録します。登録時にはエージェントのオーナー(責任者)、利用者、接続先を一元管理し、誰の責任で何のためのエージェントなのかを明確にします。

- 「制御・保護」を担う「API Access Management / Privileged Credential Management」:登録されたエージェントに対し、「何をどこまでできるか」というスコープを制御します。企業リソースへのアクセス権限を厳格に管理するだけでなく、シークレットや特権アカウントなどの強力な認証情報を安全に保管・提供することで、エージェントによる過剰な権限行使を防ぎます。

- 「統制」を担う「Governance for Agents as a Resource」:最後の段階として、定期的な棚卸しを実行します。ISMSやプライバシーマークの要件に応じた自動棚卸しはもちろん、退職者に紐づいたAIエージェントの検出や、設定変更をトリガーとした能動的な監査も可能です。

さらに今後は、サービス間でセキュリティ異常をリアルタイムに共有する標準規格「Shared Signals Framework(SSF)」を用いて、AIエージェントの予期せぬ動作をサードパーティ製品から検知した際、即座に認証情報を無効化する「Universal Logout for AI Agents」を実現します。

「野良AIエージェント」への迅速な対応

「可視化」のプロセスで、万が一未承認のAIエージェント、いわゆる野良AIエージェントが検出された場合は、組織のポリシーに応じた迅速かつ柔軟な修復が可能です。

まず、そのAIエージェントが企業として利用を認めていない、あるいはセキュリティリスクが高い場合、対象エージェントのアクセスを即座にブロックし、接続されているすべてのアプリケーションにわたってセッションを強制終了させることができます。もちろん、OAuthを通じてそのAIエージェントにアクセス許可を与えた従業員が特定できるため、ブロック前に直接ユーザーに連絡し、利用目的や状況を確認することも可能です。

そのAIエージェントが業務上有効であると判断した場合は、野良AIエージェントのまま放置するのではなく、OktaのUniversal Directoryに公式なAIエージェントとして登録し、Oktaで管理するアプリケーションと対応づけて集中管理します。これにより、特定の人間を所有者(オーナー)として割り当てたり、常時接続の特権を排除して時間制限付きのアクセス権に変更したりするなど、適切なセキュリティとガバナンスの枠組みに組み込むことが可能になります。登録されたAIエージェントだけが企業リソースにアクセスできるというフェールセーフの考えが、管理の全体を貫いています。

認可制御の新標準プロトコル「Cross App Access」

制御と保護のフェーズでAIエージェントを企業リソースに接続する方式のひとつとして、Oktaでは「Cross App Access」という標準プロトコルを標準化団体IETFに提案・推進しています。これは、アプリケーション間の認可を担うOAuthプロトコルを拡張したオープンな仕組みで、現在IETFのOAuthワーキンググループにドラフトとして採択されています。

現状、AIエージェントが企業リソースにアクセスする際の同意画面はその都度ユーザーへの確認を求めますが、一般ユーザーが権限の内容を正確に理解し判断するのは困難ですし、その判断に企業のポリシーが介在していないことも問題となっています。Cross App Accessを活用することで、認可の制御を企業の管理者がポリシーとして正しく定義し、管理できるようになります。

企業独自のアプリケーションへの組み込みは仕様をすでに公開しており、すぐに対応可能な状態です。また、各アプリケーションベンダーとの協議も進めており、より多くのサービスでこの仕組みが利用できるよう取り組んでいます。なお、Cross App Accessに対応していないケースでも、OktaではAPIキーやクレデンシャルを安全に保管し、使用後にローテーションする方式で対応しています。

中立な立場を貫くことがOktaの強み

AIエージェントを管理する製品は他ベンダーからも提供されていますが、Oktaの最大の強みは「中立性」にあります。企業が利用するアプリケーションは、Googleが中心のケースもあればMicrosoftが中心のケースもあります。また、企業買収によってIT環境が大きく変化することも珍しくありません。Oktaはどこにも偏ることなく、さまざまな環境と親和性の高いプラットフォームとして中立な立場を保ち続けています。

Okta Integration Networkには、8200以上のアプリケーションと連携してきた実績があります。この中立の思想はAIエージェントの時代でも変わりません。SalesforceのAgentforceで作られたAIエージェントも、MicrosoftのCopilot Studioで作られたAIエージェントも、Oktaで一元管理できるのです。特定のプラットフォームに依存することなく、あらゆるAIエージェントプラットフォームおよびエンタープライズアプリケーションを横断して管理できることこそが、アイデンティティ管理のリーディングカンパニーとしてOktaが提供できるユニークな価値です。

AIエージェントは今後も急速に普及し、企業の業務プロセスに深く組み込まれていくことは間違いありません。Okta for AI Agentsは、人間のアイデンティティ管理で培ってきた可視化・制御・ガバナンスという考えを、AIエージェントにも適用するソリューションです。今後もOktaでは、「AIエージェントを人間と同等のアイデンティティとして扱う」という原則のもと、企業が安心してAIエージェントを活用できる環境づくりを支援していきます。