L'IA est le changement de plateforme déterminant de notre génération et transforme rapidement les Organizations de toutes tailles et de tous secteurs. Au cœur de cette transformation se trouvent les agents d'IA, des systèmes d'IA de plus en plus autonomes qui agissent pour le compte des personnes, des équipes et des Organizations.

Chaque agent d'IA nécessite un accès aux systèmes critiques et aux données sensibles pour atteindre ses objectifs, mais cela s'accompagne souvent de zones d'ombre. Pour commencer, de nombreuses Organisations utilisent des méthodes d'authentification obsolètes qui créent une mine d'or pour les cybercriminels cherchant à exploiter des identités mal configurées ou surprivilégiées.

Une analyse récente d'Okta Threat Intelligence révèle que les approches actuelles pour accorder aux agents d'IA l'accès aux ressources d'entreprise exposent les Organizations à un risque excessif, menant à une accumulation alarmante de « dette d'identité ». Ci-dessous, nous partagerons ce que ces résultats signifient pour les entreprises et ce que vous pouvez faire à ce sujet.

Les agents d'IA accélèrent la dette d'identité

Les interactions avec les agents d'IA peuvent sembler « humaines », mais elles doivent être gérées comme des identités non humaines (NHIs). Les agents d'IA agissent de manière indépendante, et plus ils ont accès aux données, aux ressources et aux retours d'information, plus ils deviennent performants. Mais le revers de l'accès accru est un risque accru — et la possibilité d'aggraver la perte de données en cas de compromission de compte.

La dette d'identité s'accumule lorsque des secrets statiques et partagés — durables et connus ou stockés par plus d'un utilisateur — prolifèrent au sein d'un système.

Nos conclusions montrent que l'IA agentique accélère cette accumulation. Lorsqu'un agent reçoit des autorisations étendues, surtout lorsque les identifiants sont renouvelés rarement, il peut devenir un super administrateur au sein de vos Organizations, avec les clés pour entrer dans le royaume à sa guise. Si cet agent fait l'objet d'une compromission, les cybercriminels peuvent entrer et sortir de vos systèmes aussi souvent qu'ils le souhaitent.

Dans le rapport 2025 AI at Work d'Okta, lorsqu'on a interrogé les dirigeants d'organisations sur les principales préoccupations concernant l'IA, ils ont classé les risques liés à la confidentialité des données et à la sécurité des données au premier et au deuxième rang, respectivement, tant par gravité (principale préoccupation) que par fréquence (le plus souvent citée). Bien que tous les regards soient tournés vers la sécurisation de l'IA, seulement 10 % des Organizations ont une stratégie ou une roadmap bien développée pour la gestion des identités non humaines.

Ainsi, bien que nous accélérions notre chemin vers l'IA agentique — 91 % des dirigeants affirment que leurs Organizations utilisent déjà des agents d'IA — les agents mal conçus, déployés et gérés deviennent de nouveaux vecteurs d'attaque. Il suffit d'une injection d'invite ou d'une attaque de changement de personnalité pour accéder à des tokens d'accès sensibles permettant un mouvement latéral.

Pourquoi de nombreux systèmes d'agents échouent encore à externaliser le contrôle des accès — et ce que cela expose

Pour comprendre la cause de la protection non sécurisée des identifiants, nous avons déterminé qu'elle était due à l'absence de contrôle des accès externalisés.

En examinant les méthodes d'authentification utilisées pour connecter les applications de sécurité à Microsoft Copilot, notre analyse des manifestes de plugins tiers sur GitHub a révélé une tendance inquiétante dans les choix d'authentification :

Authentification de base (20 %) : Cette méthode oblige les administrateurs à télécharger les noms d'utilisateur et les mots de passe directement sur les serveurs et ne prend pas en charge l'authentification multifacteur (MFA), ce qui rend les comptes vulnérables au credential stuffing et aux attaques par password spray.

Clés API statiques (75 %) : Bien qu'elles offrent certaines améliorations par rapport à l'authentification de base (par exemple, expirations configurables, authentification multifacteur), ces tokens de longue durée sont régulièrement stockés dans les logs et enregistrés dans des fichiers en clair sur les postes de travail des Developer, ce qui en fait des cibles de choix pour les attaquants. Une fois interceptés, ces tokens peuvent fournir un accès persistant.

OAuth 2.0 (5 %) : Les flux OAuth 2.0 conçus pour les entreprises servent de contrôle des accès externalisés utilisant des token d'accès de courte durée et permettent de définir le périmètre des données requises au niveau de l'application de service, et pas seulement au niveau de l'utilisateur.

Parmi les méthodes d'authentification standard, l'authentification de base et les clés API statiques présentent un risque accru d'exposer des données sensibles. Cependant, les données sur les méthodes d'authentification utilisées pour connecter ces applications de sécurité à Microsoft Copilot indiquent une adoption lente des flux OAuth.

À mesure que les agents d'IA continuent de se développer, le respect des méthodes d'authentification de base ne fera qu'accroître la surface d'attaque des Organizations en cas de compromission.

Configurations de serveur MCP et la propagation silencieuse des identifiants statiques

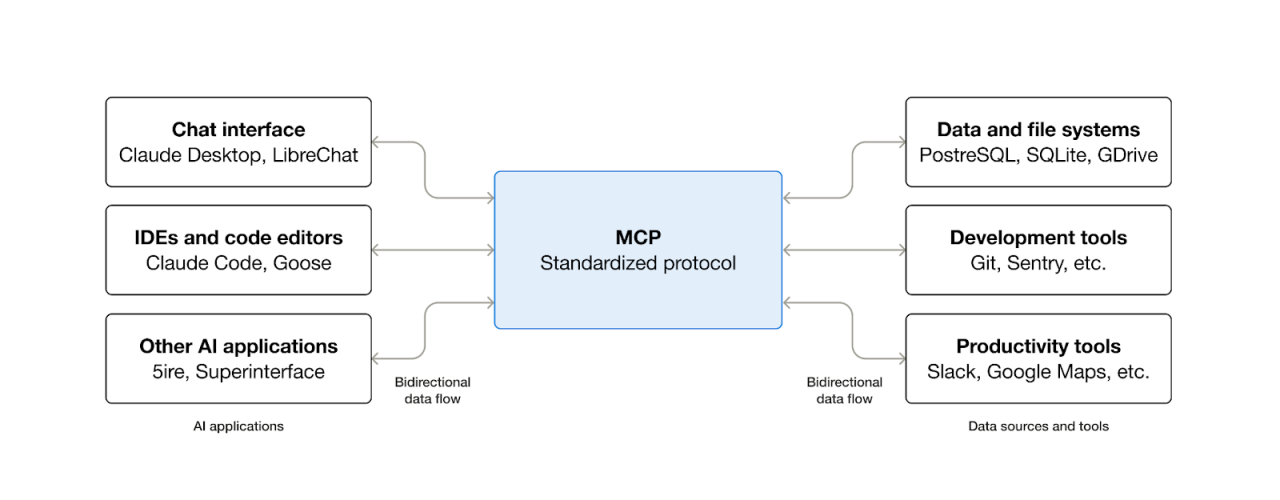

La dynamique de la croissance de l'IA agentique se construit désormais autour du Model Context Protocol (MCP), une interface standardisée connectant les systèmes d'IA et les données sous-jacentes dont ils ont besoin. L'architecture client-serveur de MCP permet aux Developer de logiciels d'intégrer facilement des applications d'IA avec les sources de donnée et les outils qui leur fournissent un contexte.

Source : modelcontextprotocol.io

Source : modelcontextprotocol.io

Les serveurs MCP nécessitent des secrets (comme des clés API et des tokens d'accès) pour se connecter aux modèles d'IA et aux sources de données distantes. Nous avons analysé l'emplacement de ces identifiants dans les fichiers de configuration et avons découvert que beaucoup étaient au format texte en clair. En raison de leur nature statique et de leur emplacement accessible, tout utilisateur peut facilement accéder à ces identifiants critiques.

Ce problème s'étend aux environnements apparemment sécurisés et prêts pour la production, ainsi qu'aux intégrations Community tierces largement utilisées qui ne sont pas approuvées par les fournisseurs de services dans les conclusions de notre rapport. Pour plus de détails sur le stockage des identifiants pour les serveurs MCP, consultez le rapport complet.

Les identifiants stockés de manière non sécurisée, telles que les clés API, ouvrent la voie aux attaquants. Dans les référentiels de logiciels, les clés API statiques sont prédominantes parmi les identifiants en clair. Les approches alternatives, telles que l'exécution de serveurs MCP dans des conteneurs, dirigent plutôt que de détourner l'accès aux secrets en texte clair. Pour le malware conçu pour localiser des chemins et des types de fichiers spécifiques où les identifiants sont stockés, les cybercriminels peuvent rapidement identifier ces tokens API statiques et amplifier l'accès aux ressources à l'échelle de l'organisation.

Source : « A look into the secrets of MCP », GitGuardian, avril 2025

Source : « A look into the secrets of MCP », GitGuardian, avril 2025

Considérations pour la gestion efficace du cycle de vie de l'identité des agents

Les systèmes d'identité ont été conçus pour sécuriser les identités humaines, mais les agents d'IA ne fonctionnent pas comme des humains. Pour gérer efficacement le cycle de vie de l'identité d'un agent, il est nécessaire d'adopter une perspective différente pour identifier les principales différences en matière de provisionnement, d'autorisations et de visibilité :

Provisionnement programmatique : Les agents sont déployés à partir d'un pipeline CI/CD et doivent être provisionnés automatiquement sans interaction humaine.

Autorisations très spécifiques : Chaque agent sert un objectif spécifique à un cas d'usage et nécessite des autorisations de niveau granulaire, équilibrées avec un accès limité dans le temps pour minimiser l'exposition.

Courte durée de vie : Les agents sont dynamiques et éphémères, ce qui signifie qu'il est nécessaire de provisionner et de déprovisionner rapidement pour gérer le champ.

Visibilité : Contrairement aux comptes humains, les agents manquent souvent de propriété traçable et d'enregistrements cohérents ; des contrôles stricts du cycle de vie et de l'identité sont nécessaires pour suivre leurs actions et le moment où elles ont été effectuées.

Une autre considération est l’adoption croissante d’outils d’intelligence artificielle (IA) tels que Gemini Code Assist et de plateformes telles que Zapier Central, ouvrant une ère de constructeurs no-code. Cette nouvelle ère a entraîné une explosion d’agents générés par les utilisateurs, qui sont rapides, évolutifs et souvent invisibles pour les équipes informatiques, remodèlant ainsi le paysage identitaire.

Recommandations pour régir et sécuriser les identités d'IA dans tous les environnements.

En tant qu'industrie, nous devons résister à la tentation de réutiliser des méthodes d'authentification obsolètes et opter plutôt pour des flux d'autorisation sécurisés conçus pour l'ère de l'IA.

Construire un avenir sûr avec l'IA agentique n'est pas seulement la responsabilité d'une seule équipe : cela nécessite un effort coordonné dans toute l'organisation :

Pour les fournisseurs de services : Priorisez l'adoption d'OAuth 2.1 comme modèle d'autorisation standard pour tous les serveurs MCP.

Pour les développeurs : Limitez les tokens API statiques aux environnements de non-production avec un périmètre des données requises limité, utilisez des coffres-forts au niveau du système d'exploitation pour extraire dynamiquement les secrets lors de l'exécution, et utilisez .gitignore pour empêcher que des fichiers sensibles ne soient accidentellement validés dans le contrôle de version.

Pour les équipes sécurité : Limitez le développement aux postes de travail sécurisés, exigez une authentification résistante au phishing pour tout accès utilisateur, et utilisez des solutions de gestion des identifiants dédiées pour la production.

Pour des recommandations plus détaillées, veuillez lire le rapport complet. Pour découvrir comment les leaders du SaaS adoptent les derniers protocoles d'identité pour sécuriser les applications d'IA agentique, inscrivez-vous à l'Okta Identity Summit on Securing Agentic AI.