このブログはこちらの英語ブログの機械翻訳です。

AIエージェントはもはや未来のものではありません。すでにここに存在し、ビジネスのバックグラウンドで機密リソースへの鍵を持って静かに稼働しています。ワークフローを自動化し、意思決定を行い、機密データとやり取りしています。しかし、これらのエージェントがより強力で自律的になるにつれて、どのようにしてそれらを保護すればよいのでしょうか?

Oktaの「AI at Work 2025」調査(260人の経営幹部を対象)によると、組織の91%がすでに平均5つの異なるユースケースでAIエージェントを使用しています。しかし、これらの非ヒューマンアイデンティティ(NHI)を管理するための戦略を十分に確立しているのはわずか10%にすぎません。これは危険な乖離を生み出します。組織は前例のない規模でAIエージェントを展開していますが、ガバナンスは後回しにされています。

その結果、強力な自律システムが適切なアイデンティティ管理なしに動作し、攻撃者が待ち望んでいるセキュリティギャップが生じるという危機が brewing されています。

新たなセキュリティの盲点

なぜ組織はAIエージェントのセキュリティに苦労しているのでしょうか。なぜなら、AIエージェントは従来のセキュリティの型を破るからです。人間の従業員をどのように保護するか考えてみてください。彼らはアイデンティティ、明確な役割、そして彼らの行動に責任を負う上司を持っています。

AIエージェントは異なります。

誰が責任者ですか?AIエージェントは、人ではなく、システムのために働くことがよくあります。このため、問題が発生した場合に誰が責任を負うのかを追跡することが困難になります。

瞬く間に現れては消える:AIエージェントは急速なペースで作成および破棄されます。このダイナミックなライフサイクルに対応できない場合、監視されていないアクセスポイントの痕跡が残り、侵害を招く絶好の機会となります。

必要なアクセス権のみを付与する: エージェントは特定のタスクを完了するために高度なアクセス権を必要とする場合がありますが、それは一瞬にすぎません。エージェントに広範な常時特権を付与することは、建物全体の鍵を渡すようなものです。

危機発生時に見えなくなる: エージェントの行動に関する明確な記録がないと、セキュリティインシデント中に何が起こったのかを把握したり、脅威を迅速に遮断したりすることはほぼ不可能です。

非決定論的である:エージェントがどのデータまたはシステムに、どのような順序で、どのくらいの期間アクセスする可能性があるかを予測するのは困難です。

簡単に言うと、AIエージェントは最新の機会、アイデンティティタイプ、および内部脅威です。ガバナンスモデルや、その特異な性質に合わせて設計されたアイデンティティセキュリティ戦略なしにAIエージェントを使用している場合、ビジネスを危険にさらしていることになります。

AIエージェントはアイデンティティセキュリティファブリックに属する

私たちは長年NHIに対処してきました。管理されていないサービスアカウントや古い認証情報など、それらを見つけ、封じ込め、管理する方法が必要です。

従来のアイデンティティモデルは不十分であり、AI時代におけるアイデンティティセキュリティファブリックのための新しい戦略が必要です。これは、一貫したスケーラブルなコントロールにより、すべての環境にわたって、あらゆるアイデンティティタイプ、あらゆるユースケース、あらゆるリソースを保護するファブリックです。

Oktaは、AIエージェントをアイデンティティセキュリティファブリックに組み込むお手伝いを近日中に開始します。ファブリックに組み込むと、次の4つのユースケースが得られます。

- 検出と発見:環境内のすべてのエージェントを積極的に見つけ、そのパターンを理解し、それらがもたらすリスクを評価します。

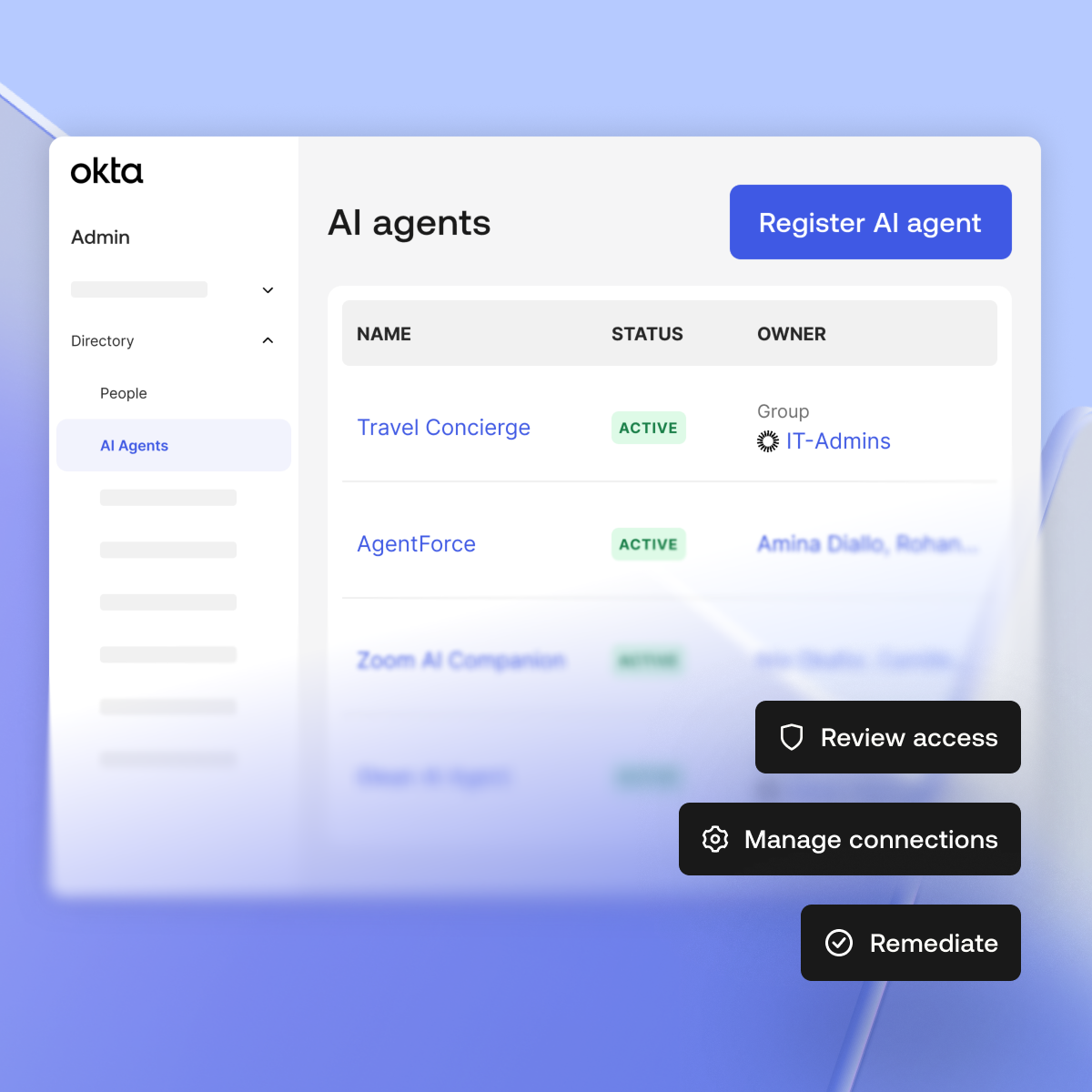

- プロビジョニングと登録: エージェントを人間のアイデンティティと同じように扱います。それぞれが、その行動に責任を負う人間の所有者にリンクされた一意のアイデンティティを持つ必要があります。

- 認可と保護:エージェントは、最近導入されたCross App Access(XAA)を通じて、必要な時に必要なアクセス権のみで動作する必要があります。これは、ユーザー、AIエージェント、およびアプリケーションが安全に接続する方法を標準化するのに役立つ新しいオープンプロトコルです。

- 管理と監視:自動化されたアクセス要求や定期的な認証を通じて、継続的なコンプライアンスを促進するための明確な監査証跡を備え、脅威を示す可能性のある異常な動作がないか、エージェントのアクティビティを常に監視する必要があります。

AIセキュリティは、最終的にはアイデンティティセキュリティの問題です。片方なしに、もう片方で成功することはできません。AIエージェントが急速に自律性と影響力を増すにつれて、可視性、制御、アカウンタビリティの必要性が急上昇します。見ることができず、管理または制御できないものを保護することはできません。

Okta for AI Agentsは2026年初頭にリリース予定です。www.okta.com/secure-ai/ で、OktaがAIエージェントのライフサイクル全体をエンドツーエンドでどのように保護するかについて詳細をご覧ください。

このブログには、現在早期アクセス段階にある製品に関する情報が含まれています。議論されている機能は、開発および改良プロセスを継続するにつれて変更される可能性があります。

早期アクセス製品であるため、バグや不完全な機能が含まれている場合があります。ここに提示されているコンテンツは情報提供のみを目的としており、将来のパフォーマンスまたは最終的な機能を保証するものではありません。