La inteligencia artificial (IA), y específicamente la IA generativa (GenAI), está ayudando a impulsar revoluciones en varias industrias. Desafortunadamente, algunos de los primeros y más agresivos adoptantes de esta tecnología han sido los ciberatacantes. El crecimiento exponencial de las capacidades de GenAI ha demostrado ser irresistible, permitiendo incluso a los delincuentes novatos llevar a cabo actividades de apropiación de cuentas más rápido y más eficazmente que nunca. Según el informe Voice of SecOps de Deep Instinct, el 75% de los profesionales de seguridad fueron testigos de un aumento de los ataques en los últimos 12 meses, y el 85% atribuye este aumento a los malos actores que utilizan la IA generativa.

En este panorama de seguridad dinámico y en rápida evolución, las pequeñas y medianas empresas (PyMEs) son particularmente vulnerables. En nuestro informe técnico State of Secure Identity de 2023, encontramos que las PyMEs tenían tasas igualmente altas de registro fraudulento e intentos de "credential stuffing" que las organizaciones de nivel empresarial (sin los recursos de personal de nivel empresarial para dedicarse al problema). Las pequeñas empresas, en particular, enfrentaron tasas significativamente más altas de intentos de omisión de la Autenticación Multifactor (MFA) que otras organizaciones de tamaño: el 20% de todos los eventos de MFA fueron intentos de omisión, en comparación con alrededor del 9% para las organizaciones empresariales y medianas. Eso se suma.

Esta publicación de blog tiene como objetivo arrojar luz sobre las amenazas de apropiación de cuentas mejoradas con GenAI que enfrentan las PyMEs, al tiempo que brinda información práctica para mejorar las medidas de ciberseguridad.

Por qué las pequeñas y medianas empresas son un punto clave para los intentos de apropiación de cuentas

Las PYMES siempre han estado en la mira cuando se trata de ciberamenazas. Aunque el tamaño de la empresa importa cada vez menos cuando se trata de tecnología e infraestructura disponibles, según el Informe de Investigaciones de Violación de Datos de Verizon de 2023, las empresas con menos de 1000 empleados seguían siendo atacadas con más frecuencia que otras. De hecho, el 69.9% de las PYMES encuestadas informaron incidentes de seguridad frente al 49.6% de las organizaciones más grandes. Las PYMES también tuvieron tasas ligeramente más altas de datos comprometidos en un ataque, con un 38% de los incidentes que llevaron a la filtración de datos en comparación con el 22% para las empresas más grandes. Solo alrededor de un tercio de las PYMES cuenta con un especialista en ciberseguridad dedicado.

Principales amenazas de apropiación de cuentas para las PyMEs

Los principiantes relativos pueden usar modelos de lenguaje grandes (LLM) disponibles públicamente para crear y escalar herramientas maliciosas y scripts de malware más rápida y eficazmente de lo que podrían sin GenAI.

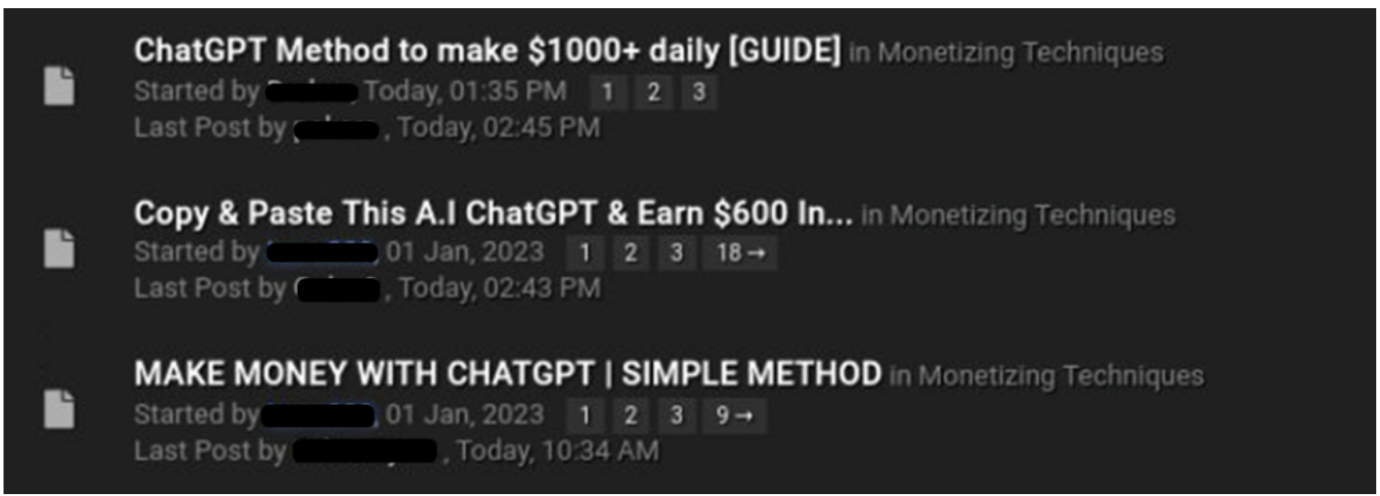

Múltiples hilos en un foro clandestino sobre cómo usar ChatGPT para actividades fraudulentas. Fuente de la imagen: Chris Fernando, Security Review, "ChatGPT is Being Used for Cyber Attacks," 2023.

Se puede ver la tormenta perfecta a la que se enfrentan las pymes al contrarrestar las amenazas de seguridad que se innovan rápidamente, como los ataques de phishing dirigidos y personalizados (spear phishing) o la clonación de voz que hace que la ingeniería social sea más sofisticada. Los bots, cuando se utilizan para ataques a escala automatizada o masiva, pueden ser un flagelo de varias maneras, incluyendo registros falsos, ataques de denegación de servicio (DDoS), ataques automatizados de fuerza bruta e inundación de usuarios con estafas y spam. Los bots impulsados por la IA suenan como una pesadilla de TI, pero también hay buenas noticias: la tecnología de detección de bots reforzada por el aprendizaje automático (ML) es significativamente mejor para reducir los ataques de bots.

Es posible mejorar la seguridad incluso cuando se trabaja con recursos limitados. Al identificar las amenazas más comunes, puedes ayudar a decidir dónde enfocar tus esfuerzos al fortalecer tu postura de seguridad contra las amenazas de GenAI.

Ataques de phishing

Las herramientas GenAI se pueden usar indebidamente para crear correos electrónicos de phishing convincentes y de aspecto profesional en cuestión de segundos; no solo phishing, sino spear phishing inquietantemente humano específicamente dirigido y personalizado al objetivo individual. Los atacantes pueden crear perfiles de apariencia creíble utilizando GenAI para crear fotos de cabeza de aspecto fotorrealista o imitar el habla humana naturalista a gran velocidad. Los malos actores también pueden usar potencialmente las herramientas GenAI para replicar la voz de una persona, lo que les permite hacerse pasar por personal clave de confianza, como líderes sénior o asistentes ejecutivos, al realizar ataques de phishing de voz (vishing) e ingeniería social.

Los intentos de inicio de sesión por prueba y error han evolucionado mucho más allá de los atacantes que adivinan nombres de usuario y contraseñas al azar. Ninguna combinación de nombre de usuario/contraseña es 100% imposible de hackear: si se les da suficiente tiempo, los malos actores eventualmente pueden descifrar cualquier combinación. Antes, los ciberataques inteligentes involucraban herramientas para acelerar las cosas. Con la IA, este tipo de ataques son aún más sofisticados.

El "credential stuffing" es un tipo popular de ataque de fuerza bruta que implica la inyección automatizada de combinaciones de nombre de usuario y contraseña comprometidas para obtener acceso fraudulento a las cuentas de usuario. Las filtraciones de credenciales y las políticas de contraseñas deficientes permiten a los atacantes obtener acceso a las cuentas mediante el uso de contraseñas filtradas previamente.

Elementos imprescindibles para la seguridad de las PyMEs

Comprender el panorama tecnológico cambiante puede capacitar a las empresas para enfrentar las amenazas emergentes. Cuando sabes cómo los actores maliciosos usan la IA, realizas inversiones más inteligentes y refuerzas la postura de seguridad donde más lo necesitas. Antes de entrar en herramientas de seguridad específicas dirigidas a la IA, aquí te mostramos cómo puedes mantenerte más seguro independientemente de la amenaza.

Mantenga el software actualizado

El software sin parches es una de las prácticas de seguridad más comunes y es así como comienzan muchas filtraciones de datos. No permita que los atacantes lo golpeen en una vulnerabilidad sin parchear.

Implementar MFA y autenticación resistente al phishing

Si leíste nuestra publicación de blog de SMB sobre MFA, probablemente esperabas este consejo. Obtén MFA sólida y resistente al phishing, y no tengas miedo de endurecer tus políticas de autenticación: bloquea los inicios de sesión en ubicaciones anómalas, los nodos de salida de Tor (la darknet), las VPN públicas y los anonimizadores de red, y los dispositivos sin garantía.

Educar

Considere que la educación adecuada sobre la identificación de amenazas mejoradas por la IA puede convertir a cada usuario en un posible respondedor de seguridad. Arme a los empleados y usuarios finales con conocimiento y ejemplos de cómo los ataques son cada vez más personalizados y sofisticados. Introduzca capacitación sobre tipos de amenazas, detección de señales de alerta comunes y reporte de actividad sospechosa: es mejor un falso positivo que una brecha no reportada.

Supervisa tus operaciones y tu postura de seguridad

¿Cómo puedes monitorear tu postura de seguridad si no la estás rastreando? Evalúa y monitorea la configuración y las políticas de tus sistemas para realizar un seguimiento de tus niveles de riesgo y los requisitos de remediación. Las funciones como Okta Insights pueden aprovechar los datos para verificar continuamente tus niveles de riesgo y ayudarte a protegerte contra los ataques de identidad, proporcionar a los usuarios finales una forma sencilla de informar sobre actividades sospechosas y recomendar formas de reforzar tu postura de seguridad. Okta Identity Threat Protection extiende la evaluación continua de riesgos, el monitoreo y la remediación a todos tus sistemas críticos.

Protección contra ataques

Algunas tecnologías que protegen contra la IA también pueden mejorar tu postura de seguridad contra amenazas más tradicionales. No importa qué, estás agregando valor a tu negocio y asegurando tus datos con herramientas fáciles.

- Bot Detection

- Para Customer Identity, Bot Detection le ayuda a discernir entre humanos y bots. Configure fácilmente los niveles de Bot Detection según la tolerancia al riesgo y las necesidades comerciales de su organización para activar un paso CAPTCHA en la experiencia de inicio de sesión para eliminar el tráfico de bots y scripts.

- Detección de Fuerza Bruta

- Con Workforce Identity, la GenAI elimina la pesada carga de los intentos de inicio de sesión de prueba y error. Protégete contra el password spraying, el credential stuffing y los ataques de fuerza bruta con un modelo basado en ML que detecta de forma óptima las organizaciones bajo ataque y marca las IP maliciosas con ThreatInsight.

- Automatización para garantizar la coherencia y reducir los errores

- El error humano ocurre. Al reemplazar la necesidad de procesos manuales, también puede reducir el riesgo de errores asociados con la administración manual de identidades. El desaprovisionamiento automático garantizado para Workforce o las alertas de amenazas automatizadas en sistemas y datos aislados para Customer Identity son solo algunas posibilidades.

- MFA resistente al phishing

- Si bien la adopción de la Autenticación Multifactor (MFA) es esencial para reducir el riesgo, no todas las formas de MFA son igualmente seguras. La MFA es oficialmente resistente al phishing cuando puede contrarrestar los intentos de eludir el proceso de autenticación, generalmente (pero no exclusivamente) a través del phishing. En Okta, defendemos Fastpass, lo que permite un acceso criptográficamente seguro a través de dispositivos, navegadores y aplicaciones al tiempo que simplifica el inicio de sesión para el usuario final. Para Customer Identity, también tenemos Adaptive MFA basada en IA.

- Políticas de seguridad que verifican la red, los patrones de acceso, la ubicación y el dispositivo

- Si tener la tecnología es el primer paso, el segundo es no ser aprensivo a la hora de establecer políticas de seguridad. Bloquear los inicios de sesión desde geografías específicas, la darknet (nodos de salida de Tor) y los dispositivos sin garantía.

Haga que la IA trabaje para usted con Okta

Hemos estado utilizando la IA en nuestra tecnología en Okta durante un tiempo. Resulta que Identity se adapta bien a la aplicación de GenAI. Nuestra detección de bots impulsada por IA, por ejemplo, utiliza el aprendizaje automático para reducir los ataques de bots maliciosos en un 79 % con un impacto negativo mínimo en el usuario final legítimo. La ola de GenAI puede parecer intimidante, pero con las herramientas adecuadas puede enfrentarla como un profesional.

Con suerte, comprendes mejor cómo preparar tu negocio para el éxito al contrarrestar los ataques cibernéticos cada vez más sofisticados. ¿Tienes curiosidad por obtener más información o estás listo para realizar un cambio ahora? Consulta nuestros otros recursos o haz clic aquí para chatear con un especialista en ventas.

Lecturas adicionales:

Okta & AI: Cómo la Inteligencia Artificial está Reconfigurando la Gestión de Identidad y Acceso

Lo que significa el cambio de paradigma de GenAI para la identidad