KI ist der prägende Plattformwechsel unserer Generation und transformiert Unternehmen jeder Größe und Branche rasant. Im Zentrum dieser Transformation stehen KI-Agenten, zunehmend autonome KI-Systeme, die im Auftrag von Personen, Teams und Unternehmen handeln.

Jeder KI-Agent benötigt Zugriff auf kritische Systeme und sensible Daten, um seine Ziele zu erreichen, aber dies ist oft mit blinden Flecken verbunden. Zum einen verwenden viele Unternehmen veraltete Authentifizierungsmethoden, die eine Goldgrube für Angreifer darstellen, die darauf aus sind, falsch konfigurierte oder überprivilegierte Identity auszunutzen.

Jüngste Analysen von Okta Threat Intelligence zeigen, dass aktuelle Ansätze, KI-Agenten Zugriff auf Unternehmensressourcen zu gewähren, Unternehmen einem übermäßigen Risiko aussetzen, was zu einem alarmierenden Aufbau von „Identity-Schulden“ führt. Im Folgenden werden wir erläutern, was diese Ergebnisse für Unternehmen bedeuten und was Sie in Bezug darauf tun können.

KI-Agenten beschleunigen die Identity-Schuld

Interaktionen mit KI-Agenten mögen „menschlich“ erscheinen, aber sie müssen als nicht-menschliche Identitäten (NHIs) verwaltet werden. KI-Agenten handeln unabhängig, und je mehr Zugriff sie auf Daten, Ressourcen und Feedback erhalten, desto leistungsfähiger werden sie. Die Kehrseite des erhöhten Zugriffs ist jedoch ein erhöhtes Risiko – und das Potenzial, Datenverluste im Falle eines kompromittierten Accounts zu verschärfen.

Identity debt entsteht, wenn statische, gemeinsame Geheimnisse – langlebig und von mehr als einem Benutzer bekannt oder gespeichert – innerhalb eines Systems zunehmen.

Unsere Ergebnisse zeigen, dass agentenbasierte KI diese Akkumulation beschleunigt. Wenn einem Agenten umfassende Berechtigungen erteilt werden, insbesondere wenn Anmeldedaten nur selten gewechselt werden, kann er innerhalb Ihres Unternehmens zu einem Super-Administrator mit Schlüsseln werden, um das Reich zu betreten, wann immer er möchte. Wenn dieser Agent kompromittiert wird, können Angreifer beliebig oft in Ihre Systeme ein- und ausgehen.

Im Okta’s 2025 AI at Work report gaben Führungskräfte an, dass Datenschutz- und Sicherheitsrisiken bei den größten Bedenken hinsichtlich KI sowohl nach Schweregrad (wichtigstes Anliegen) als auch nach Häufigkeit (am häufigsten genannt) an erster bzw. zweiter Stelle stehen. Obwohl alle Augen auf die Sicherung von KI gerichtet sind, haben nur 10 % der Unternehmen eine gut entwickelte Strategie oder eine Roadmap für das Management von nicht-menschlichen Identitäten (NHIs).

Während wir uns also im Schnellverfahren auf dem Weg zur agentischen KI befinden – 91 % der Führungskräfte geben an, dass ihre Unternehmen bereits KI-Agenten einsetzen –, entwickeln sich schlecht gebaute, eingesetzte und verwaltete Agenten zu neuen Angriffspunkten. Es genügt ein einziger Prompt-Injection- oder Persona-Switching-Angriff, um auf sensible Access Tokens zuzugreifen, die seitliche Bewegungen ermöglichen.

Warum viele Agentensysteme immer noch daran scheitern, Zugriffskontrollen zu externalisieren – und was das offenlegt.

Um die Ursache für den unsicheren Schutz von Anmeldedaten zu verstehen, haben wir sie auf das Fehlen von externalisierten Zugriffskontrollen zurückgeführt.

Bei der Betrachtung der verwendeten Authentifizierungsmethoden zur Verbindung von Sicherheitsanwendungen mit Microsoft Copilot ergab unsere Analyse der Drittanbieter-Plugins-Manifeste auf GitHub einen besorgniserregenden Trend bei der Wahl der Authentifizierungsmethoden:

Standardauthentifizierung (20 %): Diese Methode erfordert, dass Administratoren Benutzernamen und Passwörter direkt auf Server hochladen und unterstützt keinen MFA, wodurch Accounts anfällig für Credential Stuffing- und Passwort Spraying-Angriffe sind.

Statische API-Keys (75 %): Während sie einige Verbesserungen gegenüber der Standardauthentifizierung bieten (z. B. konfigurierbare Ablauffristen, MFA), werden diese langlebigen Token routinemäßig in Logs und in Klartextdateien auf den Rechnern der Developer gespeichert, was sie zu bevorzugten Zielen für Angreifer macht. Sobald diese Token abgefangen werden, können sie dauerhaften Zugriff gewähren.

OAuth 2.0 (5%): Für Großunternehmen geeignete OAuth 2.0-Abläufe fungieren als externalisierte Zugriffskontrollen, die kurzlebige Access Token verwenden und es ermöglichen, Scoping auf der Service-Anwendungsebene festzulegen, nicht nur auf der Benutzerebene.

Innerhalb der Mischung aus Standard-Authentifizierungsmethoden bergen die Standardauthentifizierungen und statische API-Keys ein höheres Risiko für die Offenlegung sensibler Daten. Die Daten zu den Authentifizierungsmethoden, die zur Verbindung dieser Sicherheitsanwendungen mit Microsoft Copilot verwendet werden, deuten jedoch auf eine langsame Einführung von OAuth-Abläufen hin.

Da KI-Agenten weiterhin skalieren, wird die Einhaltung von Standardauthentifizierungen den Gefährdungsbereich einer einzelnen Kompromittierung für Unternehmen nur vergrößern.

MCP-Serverkonfigurationen und die stille Verbreitung von Static Credentials

Die Dynamik des agentischen KI-Wachstums konzentriert sich nun auf das Model Context Protocol (MCP), eine standardisierte Schnittstelle, die KI-Systeme mit den benötigten zugrunde liegenden Daten verbindet. Die Client-Server-Architektur von MCP ermöglicht es Developern, KI-Anwendungen einfach per „Plug-and-Play“ mit den Datenquellen und Tools zu verbinden, die ihnen Kontext liefern.

Quelle: modelcontextprotocol.io

Quelle: modelcontextprotocol.io

MCP-Server benötigen Geheimnisse (wie API-Keys und persönliche Access Tokens), um eine Verbindung zu KI-Modellen und Remote-Datenquellen herzustellen. Wir haben den Speicherort dieser Anmeldedaten in Konfigurationsdateien analysiert und festgestellt, dass viele im Klartextformat vorlagen. Aufgrund ihrer statischen Natur und ihres zugänglichen Speicherorts kann jeder Benutzer problemlos auf diese kritischen Anmeldedaten zugreifen.

Dieses Problem erstreckt sich auf scheinbar sichere „produktionsreife“ Umgebungen und weit verbreitete Community-Integrationen von Service Providern, die von den Service Providern in unseren Berichtsergebnissen nicht empfohlen werden. Für genauere Informationen zur Speicherung von Anmeldedaten für MCP-Server lesen Sie den vollständigen Bericht.

Anmeldedaten, die auf unsichere Weise gespeichert werden, wie API-Keys, öffnen Angreifern Tür und Tor. In Software-Repositories sind statische API-Keys unter Klartext-Anmeldedaten besonders häufig. Alternative Ansätze, wie das Ausführen von MCP-Servern in Containern, leiten den Zugriff direkt auf Klartext-Geheimnisse, anstatt ihn umzuleiten. Bei Malware, die darauf ausgelegt ist, bestimmte Pfade und Dateitypen zu finden, in denen Anmeldedaten gespeichert sind, können Angreifer diese statischen API-Token schnell identifizieren und den Zugriff auf unternehmensweite Ressourcen erweitern.

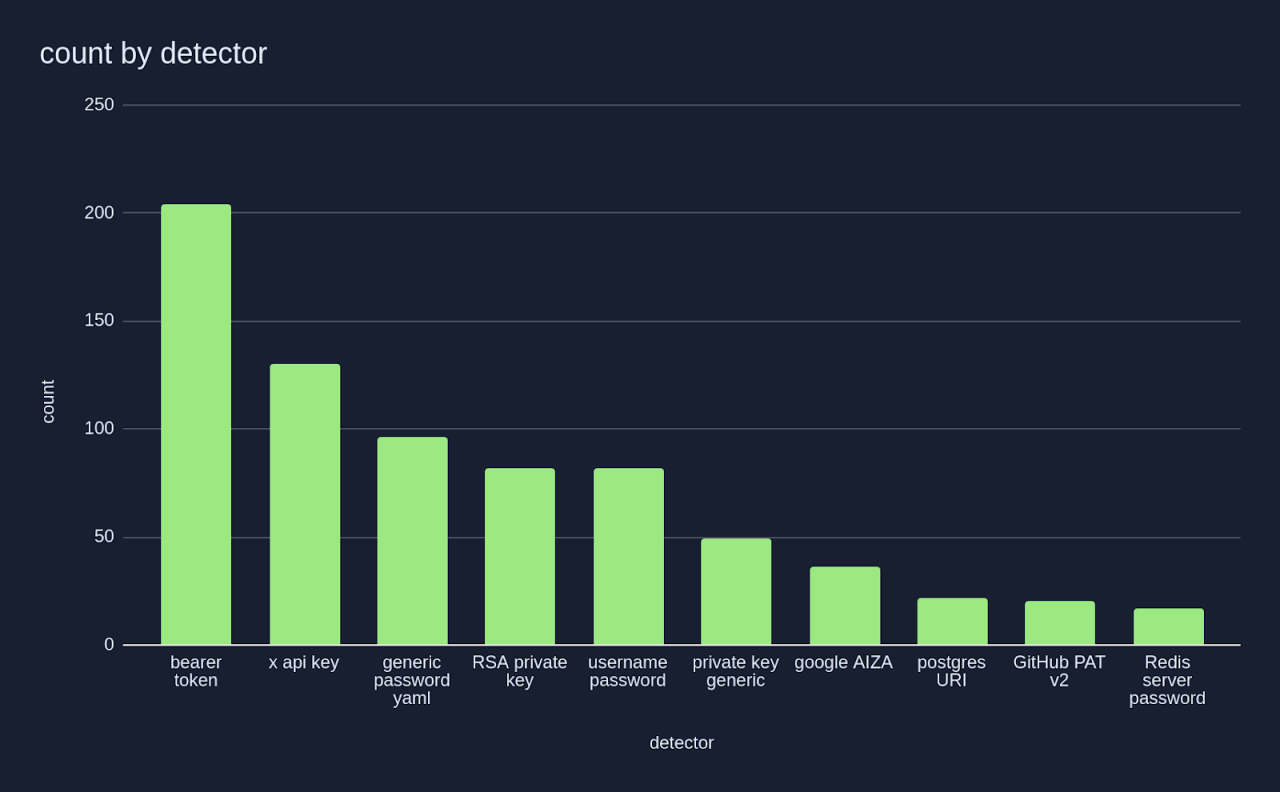

Quelle: „A look into the secrets of MCP“, GitGuardian, April 2025

Quelle: „A look into the secrets of MCP“, GitGuardian, April 2025

Überlegungen zur effektiven Verwaltung des Agent Identity Lebenszyklus

Identity-Systeme wurden entwickelt, um menschliche Identitäten zu sichern, aber KI-Agenten funktionieren nicht wie Menschen. Um den Lebenszyklus von Agent Identity effektiv zu verwalten, ist eine andere Perspektive erforderlich, um wesentliche Unterschiede bei der Provisionierung, den Berechtigungen und der Sichtbarkeit zu erkennen:

Programmatische Bereitstellung: Agenten werden aus einer CI/CD-Pipeline bereitgestellt und müssen automatisch ohne menschliches Eingreifen Provisionierung erhalten.

Hochspezifische Berechtigungen: Jeder Agent erfüllt einen spezifischen Anwendungsfall und benötigt granulare Berechtigungen, die mit einem zeitlich begrenzten Zugriff abgestimmt sind, um die Gefährdung zu minimieren.

Kurze Lebensdauer: Agents sind dynamisch und kurzlebig, was bedeutet, dass eine schnelle Provisionierung und Deprovisionierung erforderlich sind, um das Feld zu verwalten.

Sichtbarkeit: Im Gegensatz zu menschlichen Accounts fehlt es Agenten oft an nachvollziehbarer Eigentümerschaft und konsistenter Protokollierung; starke Lebenszyklus- und Identity-Kontrollen sind erforderlich, um ihre Aktionen und deren Zeitpunkt zu tracken.

Ein weiterer Aspekt ist die zunehmende Verbreitung von KI-Tools wie Gemini Code Assist und Plattformen wie Zapier Central, die eine Ära des No-Code-Builders einleiten. Diese neue Ära hat zu einer Explosion von benutzergenerierten Agenten geführt, die schnell, skalierbar und oft für die IT unsichtbar sind und die Identity-Landschaft umgestalten.

Empfehlungen zur Verwaltung und Sicherung von KI-Identitäten in verschiedenen Umgebungen

Als Branche müssen wir der Versuchung widerstehen, veraltete Authentifizierungsmethoden wiederzuverwenden, und uns stattdessen für sichere Autorisierungsabläufe entscheiden, die für das KI-Zeitalter entwickelt wurden.

Der Aufbau einer sicheren Zukunft mit agentengesteuerter KI ist nicht nur die Aufgabe eines Teams – es erfordert eine koordinierte Anstrengung im gesamten Unternehmen:

Für Service Provider: Priorisieren Sie die Einführung von OAuth 2.1 als Standardautorisierungsmodell für alle MCP-Server.

Für Developer: Beschränken Sie statische API-Token auf nicht-produktive Umgebungen mit eingeschränkten Scopings, verwenden Sie OS-Level-Secret-Vaults, um Secrets zur Laufzeit dynamisch abzurufen, und nutzen Sie .gitignore, um zu verhindern, dass sensible Dateien versehentlich in die Versionskontrolle gelangen.

Für Security-Teams: Beschränken Sie die Entwicklung auf sichere Rechner, verlangen Sie eine Phishing-resistente Authentifizierung für alle Benutzerzugriffe und nutzen Sie dedizierte Lösungen zur Verwaltung von Geheimnissen für Produktionsanmeldedaten.

Für detailliertere Empfehlungen lesen Sie den vollständigen Bericht. Um zu erfahren, wie SaaS-Führer die neuesten Identity-Protokolle einführen, um agentische KI-Anwendungen zu sichern, registrieren Sie sich für den Okta Identity Summit on Securing Agentic AI.